«Roblox» se enfrentó a una ola de nuevas demandas esta semana que alegan que la popular plataforma de juegos no ha hecho lo suficiente para salvaguardar a los niños de los pedófilos y el contenido sexual. Una de las últimas quejas, presentada en un tribunal federal en el distrito norte de California, afirma que un depredador posó como un niño en la plataforma y explotó sexualmente a un niño de 10 años en Michigan. El hombre, que no está nombrado en la demanda, supuestamente convenció a la víctima de enviar imágenes sexualmente explícitas de sí misma después de compartir algunos de sí mismo. El niño de 10 años, que es anónimo en la demanda, se reunió con el depredador el año pasado en «raBlox» y sufrió problemas de salud mental, incluida la ansiedad, según la denuncia presentada el jueves. «Lo que RoBlox representa como un espacio seguro y apropiado para los niños, de hecho, de hecho, en realidad, una vida real, una vida real», la vida real «, la vida real» es la noche real «, la vida real» es la vida real «, la vida real» es la noche real «, la vida real» es la noche real «, la vida real» es la noche real «, la vida real» es la vida real «, la vida real» es la vida real «, la vida real» es la vida real «, la vida real» es la noche real «, la vida real» es la vida real «, la vida real» es la vida real «, la vida real» es la vida real «, la vida real» es la vida real «, la vida real» es la vida real «, es la noche real». La demanda, presentada por Dolman Law Group, declaró. Los niños y los adolescentes crean, exploran y socializan en espacios virtuales en «Roblox», pero la plataforma de juegos ha seguido lidiando con las preocupaciones de seguridad infantil a medida que crecen los números de usuario y los ingresos. En promedio, 111.8 millones de usuarios visitan la plataforma diariamente. El precio de las acciones de la compañía con sede en San Mateo cerró más del 6% a $ 117.34 el viernes. «La afirmación de que Roblox pondría a nuestros usuarios en riesgo de explotación es categóricamente falso», dijo Kadia Koroma en una declaración. «Si bien ningún sistema es perfecto, Roblox ha implementado rigurosos salvaguardas, como restricciones para compartir información personal, enlaces y compartir imágenes para el usuario a usuario, para ayudar a proteger a nuestra comunidad. Desafortunadamente, los malos actores intentarán el síntoma de nuestros sistemas para tratar de dirigir los usuarios de los usuarios de la plataforma, donde los estándares de seguridad y las prácticas de moderación pueden diferir. Cumplimiento. La demanda se encuentra entre una ráfaga de nuevas quejas este año que acusan a la plataforma de juego de priorizar sus ganancias sobre la seguridad de sus usuarios. El jueves, Louisiana Atty. La general Liz Murrill presentó una demanda contra Roblox por las preocupaciones de seguridad infantil. «Roblox» también está bajo presión política. El representante Ro Khanna, un demócrata de California, ha estado instando a las personas en las redes sociales a firmar una petición pidiendo a la compañía que haga más para proteger a los niños en la plataforma. Desde julio, Dolman Law Group ha presentado cinco demandas contra «Roblox» en los tribunales de California, Georgia y Texas. Matthew Dolman, un abogado de Florida que es socio gerente en el bufete de abogados, dijo que se presentará una sexta demanda el viernes. Las demandas apuntan a varios pasos «Roblox» podría haber tomado para hacer que la plataforma sea más segura, como verificar las edades a través del reconocimiento facial, claramente advirtiendo a los padres sobre los predadores sexuales y poner una mayor edad para su aplicación «. Esto es solo el salvaje oeste, dijo Dolman en una entrevista. «Es como un campo de caza para los depredadores». La compañía, dijo, tergiversa cuán segura es la plataforma tanto para sus usuarios como para sus accionistas. «Roblox» se beneficia de las tarifas de transacción cuando los depredadores ofrecen a los niños Robux, una moneda digital utilizada en la plataforma de juegos, a cambio de fotos explícitas sexualmente, según la demanda federal presentada el jueves. Los depredadores también les dirán a los niños que no publicarán estas fotos si entregan a Robux, alega la demanda. La queja cita un informe de investigación de Hindenburg publicado el año pasado que declaraba que había juegos inapropiados en «Roblox» a los que los investigadores pudieron acceder al registrarse cuando era niño. Algunas de esas experiencias fueron modeladas después de la conducta criminal por parte del delincuente sexual infantil Jeffrey Epstein. «Roblox» refutó las reclamaciones hechas en el informe y dijo que invirtió en gran medida en sus esfuerzos de confianza y seguridad, señalando que tiene reglas contra la explotación de los niños en su plataforma. El riesgo de sextortion, especialmente entre los jóvenes, es un problema creciente, dicen los defensores de los niños. Aproximadamente 1 de cada 5 adolescentes experimentaron sextortion, según un informe de Thorn, una organización sin fines de lucro de seguridad infantil. Los sextoristas han utilizado una variedad de plataformas, incluidas las redes sociales y las plataformas de juego como «Roblox», «Minecraft» y «Fortnite», para amenazar a las víctimas.

Etiqueta: plataforma

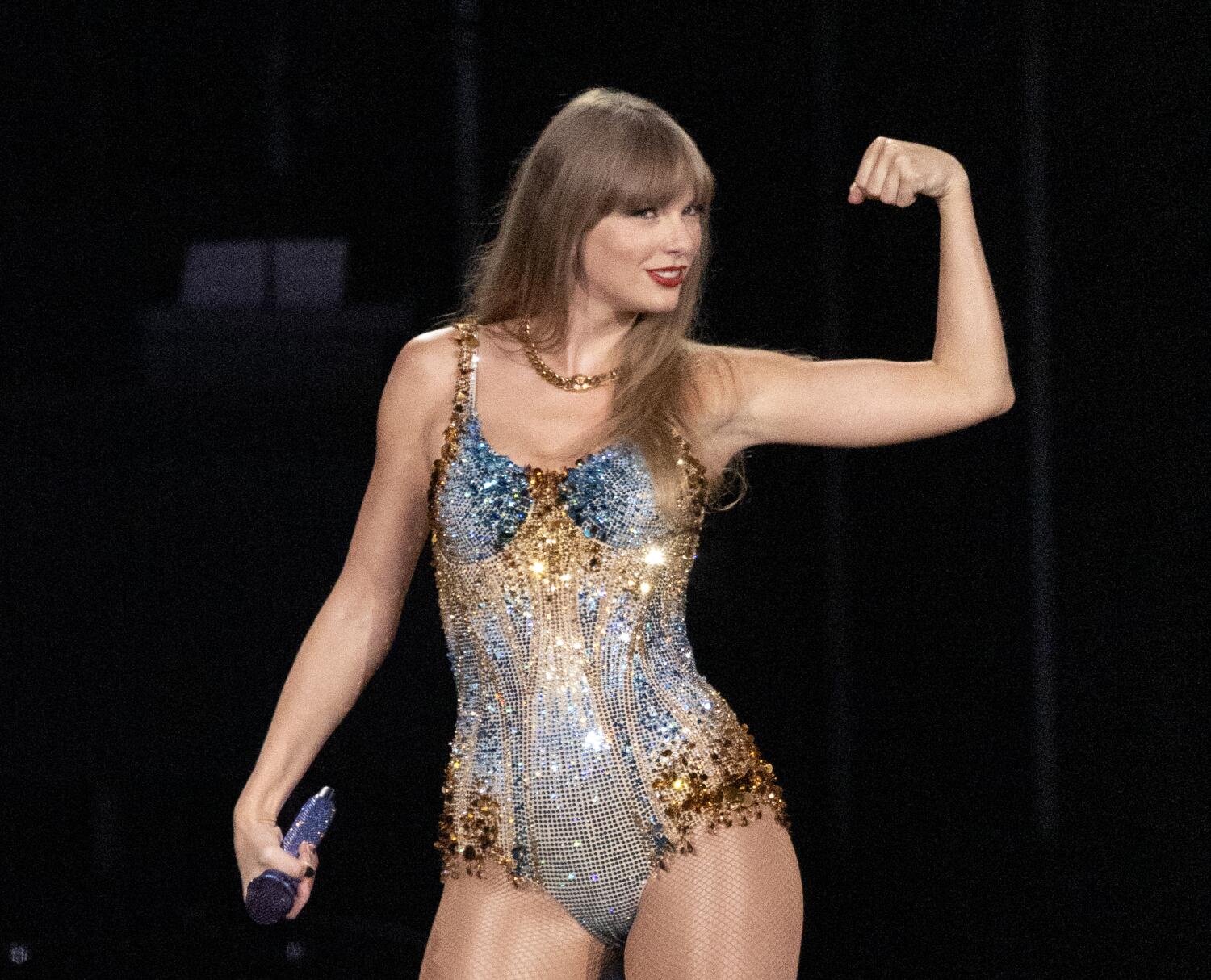

Taylor Swift finalmente está fuera de peligro, al menos en lo que respecta a las búsquedas en la plataforma de redes sociales XX (antes Twitter) que levantó su bloqueo temporal en los resultados de búsqueda de la ganadora del Grammy el lunes por la noche. El bloqueo de la plataforma fue parte de sus esfuerzos por limitar la difusión de imágenes explícitas de Swift después de que se volvieron virales la semana pasada. A partir del martes por la mañana, una búsqueda de «Taylor Swift» arroja una lista de tweets, cuentas de redes sociales y otros medios de forma normal. Es posible que las búsquedas del cantante de “Out of the Woods” hayan regresado, pero el jefe de operaciones comerciales de X, Joe Benarroch, dijo que la plataforma continuará con sus esfuerzos de moderación. «La búsqueda se ha vuelto a habilitar y continuaremos atentos a cualquier intento de difundir este contenido y lo eliminaremos si lo encontramos», dijo Benarroch en un comunicado. En medio de las protestas de los fanáticos de Swift en las redes sociales, los legisladores y el sindicato de actores SAG-AFTRA, X hizo que el nombre de la diva del pop no fuera visible en su plataforma durante el fin de semana. El lunes por la tarde, al buscar el nombre de Swift sin comillas, aparecía una página de error que decía: “Algo salió mal. Intente recargar”. “Esta es una acción temporal y se hace con mucha precaución, ya que priorizamos la seguridad en este tema”, dijo Benarroch en una declaración anterior. La semana pasada, varias imágenes explícitas generadas por IA del “Bejeweled” y el “Cruel Summer” circuló en X. Las imágenes manipuladas eran pornográficas y hacían referencia al romance de alto perfil del jugador de 34 años con el ala cerrada de los Kansas City Chiefs, Travis Kelce. Horas después de que aparecieran las imágenes el jueves, el equipo de seguridad de X recordó a los usuarios su “cero -política de tolerancia” sobre el intercambio de “imágenes de desnudos no consensuales (NCN)”. La declaración, que no menciona explícitamente a Swift, también dice que los usuarios que publicaron las imágenes serían responsables. «Estamos monitoreando de cerca la situación para garantizar que cualquier violación adicional se aborde de inmediato y que el contenido se elimine», dijo la seguridad de X. cuenta agregada. «Estamos comprometidos a mantener un entorno seguro y respetuoso para todos los usuarios». La nueva acción de búsqueda restringida de X no estuvo exenta de errores. A partir del lunes por la tarde, buscar el nombre completo de Swift entre comillas o agregar palabras adicionales al final de la frase de búsqueda “Taylor Swift” generó publicaciones, respuestas e imágenes como de costumbre, incluidas falsificaciones gráficas de Swift. El director ejecutivo de Tesla, Elon Musk, que se hizo cargo oficialmente de Twitter en octubre de 2022, realizó recortes en el equipo de moderación de la plataforma, que tenía la tarea de hacer cumplir las reglas contra el contenido dañino. La compañía anunció el viernes que busca mejorar sus “mecanismos de detección para encontrar más contenido reportable” y contratar más personal moderador como parte de sus esfuerzos para combatir la explotación sexual infantil. Un representante de X no respondió de inmediato el lunes a la solicitud del Times de comentario. Swift aún no se ha referido públicamente a las imágenes explícitas, pero la controversia reavivó las conversaciones sobre la inteligencia artificial y la necesidad de una mayor supervisión, especialmente porque la creación de imágenes de IA continúa afectando abrumadoramente a mujeres y niños. «Taylor Swift es espantoso y, lamentablemente, les está sucediendo a las mujeres en todas partes, todos los días», dijo el representante de Nueva York Joe Morelle en un tuit el jueves. «Es explotación sexual», añadió, antes de promocionar su propuesta de ley para prevenir las falsificaciones profundas de imágenes íntimas. un proyecto de ley que haría ilegal compartir pornografía deepfake sin el consentimiento de las personas retratadas. La noticia de las imágenes de Swift AI generó preocupación, ya que el director ejecutivo de Microsoft, Satya Nadella, y la secretaria de prensa de la Casa Blanca, Karine Jean-Pierre, abordaron la controversia por separado el viernes. “Esto es muy alarmante. Por eso, haremos todo lo que podamos para abordar este problema”, dijo Jean-Pierre durante una rueda de prensa, según Reuters. “Entonces, si bien las empresas de redes sociales toman sus propias decisiones independientes sobre la gestión de contenidos, creemos que tienen un papel importante que desempeñar en hacer cumplir sus propias reglas para evitar la difusión de información errónea y de imágenes íntimas y no consensuadas de personas reales”. AFTRA, que estableció términos relacionados con la inteligencia artificial en su contrato de 2023, calificó las imágenes de inteligencia artificial de Swift como «perturbadoras, dañinas y profundamente preocupantes». «El desarrollo y la difusión de imágenes falsas, especialmente aquellas de naturaleza lasciva, sin el consentimiento de alguien deben «Será ilegal», dijo el sindicato en un comunicado el viernes. «Como sociedad, tenemos en nuestro poder controlar estas tecnologías, pero debemos actuar ahora antes de que sea demasiado tarde».

Source link

La plataforma de experiencia digital cuenta con auditores externos que confirman las prácticas de seguridad, los controles y la protección de los datos de clientes y socios. BOSTON, MA, EE. UU., 2 de enero de 2024 /EINPresswire.com/ — Exoprise, líder en monitoreo de experiencia digital (DEM) convergente para lugares de trabajo digitales, anunció hoy que ha completado con éxito su certificación de Control de organización de servicios (SOC) 2 Tipo II. El SOC 2 es un estándar de auditoría desarrollado por el Instituto Americano de Cuentas Públicas Certificadas (AICPA). Después de una revisión exhaustiva de los controles, prácticas, procesos comerciales y más de Exoprise por parte de auditores profesionales externos, Exoprise demostró que cumplía con creces los requisitos. para lograr la certificación SOC 2. “A medida que la plataforma Exoprise ha crecido con el tiempo, también lo han hecho nuestros controles y procedimientos internos necesarios para proteger los datos de los clientes”, dijo Jason Lieblich, director ejecutivo de Exoprise. “Estamos comprometidos a ofrecer el más alto nivel de seguridad y privacidad de los datos, y la auditoría SOC 2 es una parte clave de ese compromiso. Continuaremos invirtiendo en infraestructura de seguridad para garantizar que los clientes nos confíen sus datos confidenciales”. SOC 2 define criterios para administrar los datos de los clientes basándose en cinco “principios de servicio confiable”: seguridad, disponibilidad, integridad del procesamiento, confidencialidad y privacidad. La certificación demuestra la capacidad de una empresa para implementar políticas de seguridad críticas y demostrar el cumplimiento durante un período prolongado. Completar con éxito la auditoría SOC 2 Tipo II reafirma la dedicación de Exoprise a sus clientes actuales y futuros. Aprovechar la automatización y las prácticas que ya existían simplificó la realización del proceso de evaluación requerido. Exoprise pudo demostrar excelencia en las mejores prácticas para cada una de las categorías auditadas. Para obtener más información sobre las soluciones de Exoprise, visite https://www.exoprise.com/. Recursos adicionales • Solicite una demostración de Exoprise • Vea más sobre las funciones de Exoprise • Obtenga más información sobre Service WatchAcerca de ExopriseExoprise brinda a los equipos de TI empresariales soluciones de monitoreo de experiencia digital que optimizan el lugar de trabajo digital, brindando visibilidad de toda la cadena de prestación de servicios, desde la infraestructura de la nube hasta la experiencia del usuario final. La plataforma Exoprise ayuda a los equipos de TI a anticipar, solucionar problemas y optimizar la experiencia digital mediante el seguimiento del rendimiento de las aplicaciones de misión crítica y las redes que las respaldan. Con información en tiempo real sobre la experiencia digital, los clientes de Exoprise pueden mejorar la productividad de los empleados, reducir los costos de soporte de TI y mejorar la satisfacción del cliente. Para obtener más información, visite exoprise.com.Exoprise MarketingExoprise+1 781-209-5653marketing@exoprise.com

Source link

Los legisladores de California aprobaron el miércoles un proyecto de ley destinado a combatir el material de abuso sexual infantil en plataformas de redes sociales como Facebook, Snapchat y TikTok. La legislación, el Proyecto de Ley 1394, responsabilizaría a las empresas de redes sociales por no eliminar el contenido, que incluye pornografía infantil. y otro material obsceno que representa a niños. “El objetivo del proyecto de ley es poner fin a la práctica de que las redes sociales sean una autopista para materiales de abuso sexual infantil”, dijo en una entrevista la asambleísta Buffy Wicks (demócrata por Oakland), autora de la legislación. El proyecto de ley fue aprobado por unanimidad en el Senado el martes. La Asamblea aprobó por unanimidad una versión enmendada del proyecto de ley el miércoles y ahora se dirige al escritorio del gobernador para su consideración. Los esfuerzos para aprobar un paquete de proyectos de ley para hacer que las redes sociales sean más seguras para los jóvenes enfrentaron una dura oposición de grupos de la industria tecnológica como TechNet y NetChoice. que temían que la legislación llevara a que las plataformas fueran demasiado cautelosas y eliminaran contenido más legal. Los grupos de seguridad infantil se enfrentaron con las empresas de tecnología por las enmiendas propuestas al proyecto de ley que temían que facilitarían que las plataformas de redes sociales evitaran la responsabilidad por no eliminar materiales de abuso sexual infantil. Wicks hizo cambios al proyecto de ley la semana pasada, retrasando la fecha en que entraría en vigor hasta enero de 2025. Las enmiendas también dan a las empresas de redes sociales más tiempo para responder a un informe sobre material de abuso sexual infantil y una forma de pagar una multa más baja si cumplen con los requisitos. ciertos requisitos. Los grupos tecnológicos, incluidos NetChoice y TechNet, aún se opusieron al proyecto de ley después de que Wicks hiciera enmiendas, diciendo a los legisladores que aún enfrentaría desafíos legales en los tribunales. Los grupos, junto con organizaciones empresariales como la Cámara de Comercio de California, instaron a los legisladores a retrasar la aprobación del proyecto de ley hasta el próximo año. “El proyecto de ley impreso no da en el blanco y seguramente resultará en un litigio”, dijeron los grupos en una alerta enviada a los legisladores. Otra legislación dirigida a las plataformas de redes sociales desapareció a principios de este mes, lo que subraya el rechazo que enfrentan los legisladores por parte de las empresas de tecnología. La batalla se ha extendido más allá de la Legislatura de California y ha llegado a los tribunales. Los legisladores aprobaron una legislación sobre seguridad infantil en línea en 2022, pero grupos como NetChoice han demandado al estado para impedir que la ley entre en vigor. X, anteriormente Twitter, demandó a California la semana pasada por una ley que tenía como objetivo hacer que las plataformas de redes sociales sean más transparentes sobre cómo moderan el contenido. Wicks dijo que confía en que su proyecto de ley resistirá cualquier posible desafío legal. “Estas empresas saben que tienen que asumir un papel más proactivo para ser parte de la solución al problema”, dijo. “Este proyecto de ley va a forzar esa conversación y la requerirá”. Según el proyecto de ley, las empresas de redes sociales tendrían prohibido “facilitar, ayudar o incitar a sabiendas a la explotación sexual comercial”. Se requeriría que un tribunal otorgara daños y perjuicios entre $1 millón y $4 millones por cada acto de explotación que la plataforma de redes sociales «facilitó, ayudó o instigó». abusar del material en el que aparecen representados y responder al informe dentro de las 36 horas. Se requeriría que la plataforma bloqueara permanentemente la visualización del material. Si la empresa no lo hiciera, sería responsable de los daños y perjuicios. Las empresas de redes sociales podrían recibir una multa de hasta 250.000 dólares por infracción. La multa se reduciría a $75,000 por infracción si cumplen ciertos requisitos, incluida la denuncia del material de abuso sexual infantil al Centro Nacional para Niños Desaparecidos y Explotados (NCMEC) y la participación en un programa llamado “Take It Down” que ayuda a los menores a derribar imágenes sexualmente explícitas y fotografías de desnudos. El programa asigna una huella digital a la imagen o video denunciado para que las plataformas puedan encontrar materiales de abuso sexual infantil. Según la versión enmendada del proyecto de ley, tendrían 36 horas para retirar los materiales después de recibir esta huella digital del NCMEC. La ley federal ya exige que las empresas informen material de abuso sexual infantil al NCMEC y las principales plataformas en línea, incluidas Facebook, Instagram, Snap y TikTok, participan en el programa Take It Down.

Source link

Los influencers han ganado. Las instituciones de medios digitales se están desmoronando. Hemos pasado al vídeo. La Internet de la década de 2020 está dominada por un puñado de plataformas (Instagram, TikTok, Spotify, YouTube) y los creadores que las gobiernan. Ahora incluso la poderosa industria del entretenimiento está esclavizada por ellos. La historia de cómo llegamos hasta aquí es el tema del nuevo y convincente nuevo libro de Taylor Lorenz, “Extremely Online”, y es, en el fondo, una historia sobre el atractivo de la fama. el deseo de actuar para ganarse la vida y cómo las empresas que buscan sacar provecho de esos impulsos básicos alientan a los aspirantes a mercantilizar su experiencia personal. Es, en otras palabras, una historia de Los Ángeles. “Toda la industria creadora de contenido tiene su sede en Los Ángeles y realmente surgió de Los Ángeles”, me dice Lorenz. “No olvidemos que la primera plataforma que lanzó el espacio de influencers fue Myspace, y que tenía su sede en Los Ángeles” ¡Es cierto! Myspace, la primera red social dominante a nivel mundial, no surgió de Cupertino o Menlo Park u otro bastión del Gran Silicon Valley, sino de un pequeño subconjunto de empleados que trabajaban para la firma de marketing EUniverse en Los Ángeles. La idea clave del libro de Lorenz es que la Internet que conocemos hoy fue moldeado tanto por sus usuarios más influyentes (a quienes las plataformas atienden y promueven activamente) como por los programadores, fundadores y empresarios que erigieron la infraestructura digital. Cuando la gente denuncia el estado actual de la web y cómo está dominada ahora por contenido impulsado por la personalidad como el que se encuentra en TikTok, Instagram, YouTube y Twitch, generalmente apuntan a algoritmos que incentivan comportamientos salvajes y empresas que enfatizan el compromiso y las ganancias por encima de la calidad y la preocupación pública. Eso está bastante bien, al menos desde donde estoy sentado. Pero esa narrativa omite un ingrediente clave: las personas que sobresalen en ofrecer su comportamiento salvaje para el consumo público; las personas que crean, como podríamos decir en el Década de 2020, el compromiso. ¿Y qué ciudad tiene la mayor densidad de población de artistas entusiastas y capacitados per cápita, tal vez en el mundo? Los Ángeles Es lógico, como lo hace Lorenz, que si los ingenieros del Área de la Bahía conectaron el cuerpo de Internet, entonces Los Ángeles sea su corazón palpitante. “Hablé con los creadores de contenido para este libro y dijeron que sintieron que hasta que se mudaron a Los Ángeles, no eran creadores de contenido reales”, dice. “Creo que esto se debe a que, a pesar de que la gente piensa que el auge de las redes sociales es sinónimo de Silicon Valley, como sostengo en mi libro, estas plataformas están muy determinadas por los usuarios, y específicamente por los usuarios avanzados: los creadores de contenido. Y, añade, «casi exclusivamente, esos creadores de contenidos han estado en Los Ángeles». Es un cliché tan histórico como el propio sueño americano: partir hacia Hollywood con una maleta y aspiraciones de estrellato, pero también es una realidad innegable de cómo La economía local funciona, y esos soñadores son un recurso latente y muy valioso para todas esas plataformas, para decirlo en términos simples. Desde que Myspace Tom y su cohorte fundaron esa red social aquí, no sólo ha habido una oferta activa de talento sino también una Se construyó un canal cada vez más sofisticado para conectar ese talento con el Myspace del momento. En 2009, como señala Lorenz, se estableció la primera llamada casa de contenido para dar cabida a creadores de tiempo completo que hacían videos para plataformas como YouTube: la Station, en Playa de Venice. Desde entonces, a medida que los creadores tuvieron éxito al reunir seguidores, ha surgido una serie de agencias de talentos y compañías de medios de propiedad independiente. Esta, por supuesto, ha sido un arma de doble filo, pero Lorenz desea señalar que el nuevo panorama dio cabida a muchas voces que los viejos medios y los estudios heredados de Hollywood estaban ignorando. El auge de la economía de los influencers, dice ella , “ha sido una verdadera fuerza positiva para muchas personas marginales, como los blogueros de belleza, que atienden a mujeres de color que fueron ignoradas y difamadas”, aunque “a mucha gente le gusta centrarse en lo malo, los Jake Paul. » “Extremely Online”, de Taylor Lorenz (Simon & Schuster) De todos modos, a pesar de verse eclipsada por los principales estudios y gigantes como Netflix, la economía influyente de Los Ángeles ahora valdrá medio billón de dólares en los próximos años, dice Lorenz, citando un informe. de Goldman Sachs. “La gente pensaba que el futuro de los medios sería BuzzFeed o Vox”, dice, “pero el verdadero futuro se está construyendo en Los Ángeles. Ahí es donde vemos este sólido ecosistema de talento creativo que utiliza Internet para remodelar Hollywood”. «Las películas viven y mueren ahora gracias a TikTok, no al revés». Los críticos han criticado el libro de Lorenz por ser demasiado comprensivo con los influencers que luchan por llegar a la cima en este nuevo ecosistema, pero he descubierto que el libro es bastante agnóstico. en su enfoque: informar sobre una nueva frontera del entretenimiento que puede parecer extraña para muchos, pero que es una fuerza innegable en la vida cultural y económica. Y en nuestro chat, ella es muy crítica con la industria que cubre, donde la influencia de sus trabajadores creativos eclipsa por mucho cualquier protección y regulación. Habla sobre el agotamiento desenfrenado en la industria, mientras los creadores trabajan día y noche para producir contenido para sus fans. creadores que, como en todas las industrias, no son abrumadoramente tan ricos ni exitosos como los modelos con los que se asocian. Habla de los problemas de salud mental entre aquellos que se han hecho famosos demasiado rápido y de las estafas que afectan a la economía de los influencers. Lo peor de todo es que habla de la falta de barreras de seguridad para los creadores, especialmente los niños. «Hay una enorme cantidad de trabajo infantil en esta industria (y esto fue cierto en Hollywood, por cierto), con niños de hasta 13 años creando contenido», dice Lorenz. Ella le da crédito a SAG-AFTRA por reconocer el modo emergente de los medios y por su reciente Acuerdo de Influencia, que buscaba instituir protecciones y beneficios para los creadores. «Así es como muchos creadores de contenido obtienen atención médica». «La gente en los medios de la costa este no entiende cómo funciona este negocio y piensa que estas personas se toman selfies y hacen videos tontos», dice Lorenz. “Este es un verdadero trabajo creativo. El ecosistema laboral de Hollywood fue más rápido en reconocerlo”. A menudo parece que, después de más de una década de existencia, pocos saben qué hacer con la economía de los influencers o dónde encaja en la historia de Internet en general. Pero sí necesitamos saber, como lo señala hábilmente Lorenz, que la historia no comienza ni termina en Silicon Valley. Pasa por Hollywood. Mire LA Times Today a las 7 p.m. en Spectrum News 1 en el Canal 1 o transmita en vivo en la aplicación Spectrum News. Los espectadores de la península de Palos Verdes y el condado de Orange pueden verlo en Cox Systems en el canal 99.

Source link

El gobernador de California, Gavin Newsom, firmó el domingo un proyecto de ley que responsabilizaría a Instagram, TikTok y otras plataformas de redes sociales, propiedad de Facebook, por no combatir la difusión de materiales de abuso sexual infantil. Según la nueva ley, el Proyecto de Ley 1394 de la Asamblea, las redes sociales A partir de enero de 2025, las plataformas tendrán prohibido “facilitar, ayudar o instigar a sabiendas la explotación sexual comercial”. Se requeriría que un tribunal otorgara daños y perjuicios entre $ 1 millón y $ 4 millones por cada acto de explotación que una plataforma de redes sociales «facilitó, ayudó o instigó». Las plataformas podrían evitar demandas al realizar auditorías semestrales para detectar diseños, algoritmos y características potencialmente dañinos y solucionar cualquier problema. AB 1394 también requiere que las plataformas de redes sociales brinden a los usuarios de California una forma de denunciar el material de abuso sexual infantil en el que aparecen y responder al mismo. el informe en un plazo de 36 horas. Si no cumplieran con ciertos requisitos, como bloquear permanentemente la visualización del material, también serían responsables de los daños y perjuicios. La firma del proyecto de ley es una victoria para los defensores de la seguridad infantil que impulsaron la legislación en medio de una dura oposición de los grupos tecnológicos que instaron a los legisladores a retrasar su aprobación un año más. La asambleísta Buffy Wicks (D-Oakland), autora del proyecto de ley, y los defensores de la seguridad infantil aplaudieron a Newsom por firmar la legislación. “Esta ley subraya la dedicación de nuestro estado a defender a los más vulnerables entre nosotros y envía un mensaje rotundo mensaje a otros estados y plataformas tecnológicas de que el uso de Internet para explotar a los niños ya no quedará sin control”, dijo Wicks en un comunicado el lunes. Common Sense Media, una organización sin fines de lucro que aboga por la seguridad infantil en línea, dijo en un comunicado que la “autosuficiencia inadecuada «La vigilancia» de los materiales de abuso sexual infantil por parte de las empresas de redes sociales ha perjudicado a los jóvenes y sus familias. «Tenemos más trabajo por hacer para responsabilizar a las plataformas de redes sociales por los daños que causan a los niños, adolescentes y sus familias, pero hoy la firma de AB 1394 es un paso importante en la dirección correcta”, dijo Jim Steyer, fundador y director ejecutivo de Common Sense Media, que copatrocinó el proyecto de ley. Los grupos de defensa de la industria NetChoice y TechNet se opusieron a la legislación, afirmando que tendría un “efecto paralizador” sobre la libertad de expresión porque las plataformas tecnológicas podrían terminar eliminando más contenido legal o deshabilitando funciones populares entre los adolescentes. Los grupos no han dicho si planeaban demandar por la AB 1394, pero señalaron a los legisladores que podrían surgir desafíos legales. NetChoice y Technet no respondieron a una solicitud de comentarios enviada el domingo por la noche. California ya enfrenta demandas por legislación dirigida a plataformas en línea. X, anteriormente conocida como Twitter, demandó a California por una ley que requeriría que las empresas de redes sociales revelen sus políticas de moderación de contenido y proporcionen un informe al fiscal general de California. En septiembre, un juez federal también bloqueó temporalmente un proyecto de ley de seguridad infantil en línea después de que NetChoice, un grupo cuyos miembros incluyen a la empresa matriz de Facebook, Meta, Google y TikTok, presentara una demanda contra California. El material de abuso sexual infantil ha sido un problema constante para los sitios en línea. Las plataformas de redes sociales toman medidas contra millones de contenidos de explotación sexual infantil cada trimestre. Según la ley federal, deben informar el contenido al Centro Nacional para Niños Desaparecidos y Explotados. De abril a junio, Facebook tomó medidas contra 7,2 millones de contenidos que violaban sus normas contra la explotación sexual infantil, según datos reportados trimestralmente por la empresa. Durante ese mismo período, Instagram, propiedad de Facebook, tomó medidas contra 1,7 millones de contenidos que ponían en peligro a los niños.

Source link

Ha pasado casi un año desde que Elon Musk adquirió Twitter, y más que el propietario promedio, ha realizado algunos cambios en el escaparate: reemplazó la alegre mascota alada de la plataforma de redes sociales con una siniestra «X», despojó a todos los suscriptores excepto los de pago del estado verificado, y convertirlo de una encrucijada frenética de noticias y opiniones de última hora a un patio de recreo para falsedades y propaganda sembrada por malos actores. “Las redes sociales siempre son dignas de confianza”, dijo nadie, nunca. Pero una nueva guerra en Medio Oriente está haciendo que los usuarios de la plataforma desde hace mucho tiempo sean muy conscientes del daño que el director ejecutivo de SpaceX y ex presidente de Tesla ha causado en el ámbito público digital. Un nivel sin precedentes de información errónea no controlada en X ha hecho que sea exponencialmente más difícil obtener información creíble, según investigadores y grupos de verificación de hechos. Como si el conflicto entre Israel y Hamas no fuera lo suficientemente complicado, navegar por X para obtener noticias de última hora ahora significa tener que revisar capas de tonterías xenófobas, videos manipulados y/o mal etiquetados y más robots que arrojan desinformación que Facebook. alrededor de 2016. Primer ejemplo: un video viral que dice mostrar a un combatiente de Hamas derribando un helicóptero israelí es en realidad un clip del videojuego Arma 3. Ciudad de Gaza el lunes durante un ataque aéreo israelí. (NurPhoto vía Getty Images) Peor aún, la basura está lloviendo de arriba hacia abajo. El domingo, Musk sugirió que sus más de 159 millones de seguidores revisaran un par de cuentas “buenas” para “seguir la guerra en tiempo real”. Desafortunadamente, su consejo incluyó a un identificador conocido por difundir un informe falso de una explosión en el Pentágono a principios de este año, y otro que había dirigido comentarios antisemitas a un compañero usuario. (Desde entonces, Musk eliminó su recomendación). La avalancha de noticias falsas fue inevitable dados los continuos esfuerzos de Musk para desregular el espacio. Recientemente despidió a la mitad del equipo dedicado a detectar información errónea y fraude electoral en el sitio, que ya había sido reducido cuando adquirió el sitio por primera vez. Y apenas la semana pasada, X comenzó a eliminar titulares de artículos de noticias, lo que hace que sea más fácil engañar a los usuarios sobre el contenido de una historia y más difícil para los usuarios distinguir entre un enlace de un medio de noticias de buena reputación y una foto aleatoria publicada por un individuo. Estos son sólo los últimos de una serie de medidas de Musk que parecen diseñadas para sembrar dudas sobre el trabajo de fuentes legítimas como la BBC y NPR y aumentar la visibilidad de voces “alternativas”, como los supremacistas blancos y los negacionistas electorales. Y tal vez no sea una sorpresa, dado que una de las primeras acciones que tomó Musk después de asumir el control de Twitter fue restablecer muchas cuentas que habían sido previamente suspendidas por conducta de odio (el exlíder del Ku Klux Klan, David Duke), promoviendo teorías de conspiración infundadas sobre el fraude electoral. (Mike Flynn) o sobre COVID-19 (Representante de Georgia Marjorie Taylor Greene). Puede que el Salvaje Oeste de Musk haya tardado un año en gestarse, pero los últimos días han puesto de relieve que la plataforma antes conocida como Twitter -donde la mayoría de los sabuesos se han reunido para circular, celebrar y lamentar las últimas noticias durante más de una década- ya no permite ni siquiera usuarios altamente exigentes para discernir la realidad de la ficción. Cientos de miles de usuarios amplificaron un comunicado de prensa falso de la Casa Blanca publicado el sábado que afirmaba falsamente que Estados Unidos estaba enviando miles de millones de dólares en nueva ayuda a Israel. Y un vídeo que pretendía mostrar a generales israelíes capturados por Hamás, y que había sido visto más de 1,7 millones de veces hasta el lunes, en realidad mostraba, como informó CNN, la detención de separatistas en Azerbaiyán. El equipo de desinformación desnudo de X detectó algunas publicaciones engañosas o falsas, incluido un vídeo que supuestamente retrata los ataques aéreos israelíes en Gaza. Pero el mismo video y título continuaron proliferando en otras cuentas de la plataforma. Durante más de una década, Twitter implementó controles sobre las habituales peleas a gritos, teorías de conspiración y locura general de una plataforma masiva de redes sociales para limitar el comercio de falsedades. Esa diligencia debida no evitó todas las mentiras ni aplastó todos los robots, pero hizo posible que la mayoría de nosotros busquemos (condenadamente) actualizaciones sobre los eventos más importantes: la captura y asesinato de Osama bin Laden, la desaparición del MH370, la saga de Kanye y Kim, Black Lives Matter, #MeToo, la muerte de Kobe Bryant, COVID, Ucrania y más. Musk era uno de esos usuarios en aquel entonces, y su tensa relación con la plataforma se explora en el documental de Frontline “Elon Musk’s Twitter Takeover” (que se estrena el martes en PBS). La sede de Twitter en San Francisco en julio, cuando los trabajadores comenzaron a retirar los carteles después de que Elon Musk cambiara el nombre de la plataforma de redes sociales a «X». (Justin Sullivan/Getty Images) Ahora que el pajarito azul se ha ido, el tenor del lugar ha cambiado y las cosas son mucho más feas. GLAAD la llamó «la plataforma más peligrosa para las personas LGBTQ». La ADL citó un aumento del 61,3% en los tweets antisemitas dos semanas después de que Musk comprara el sitio en comparación con las dos semanas anteriores a que asumiera el control. El Centro para Contrarrestar el Odio Digital informa un aumento del 202% en los tweets que utilizan la palabra N desde que Musk tomó las riendas. El mes pasado, Musk acusó a la Liga Antidifamación (ADL) de “intentar acabar con esta plataforma acusándonos falsamente a ella y a mí de ser antisemitas” e insinuó que podría demandar a la organización anti-odio por difamación. que han convertido el lugar en un vertedero tóxico de personas que influyen en el odio y mala información, el objetivo ya no es compartir información. Se trata de gritar al vacío, por muy mal informado que sea el mensaje o cuán infundada sea la acusación. Se trata de erosionar la confianza en fuentes confiables, individuales o institucionales, y elevar a los usuarios nefastos que deben avivar el miedo, la duda y la confusión para prosperar. Y a medida que se acerca su primer aniversario, nunca ha estado más claro que Musk hará todo lo posible. para entregar.

Source link

Es un mal momento para estar en línea. Si ha iniciado sesión en cualquier plataforma de redes sociales en las últimas dos semanas, sabrá de lo que estoy hablando: desde que Hamas desató su horrible ataque contra Israel, e Israel desató Durante su horrible campaña de bombardeos de represalia en Gaza, no sólo ha habido una avalancha de historias e imágenes desgarradoras e inquietantes, sino también de vídeos falsos, publicaciones fuera de contexto, expertos falsos, discursos enfurecidos y noticias falsificadas, todo ello lloviendo en nuestras transmisiones en Los investigadores de desinformación y los periodistas han calificado el desorden como una “niebla de guerra impulsada algorítmicamente” y los analistas de noticias han denunciado la avalancha de mala información, el esfuerzo más difícil que nunca por separar los hechos de la ficción en línea. Culminó esta semana en una loca lucha por analizar la culpa de un terrible ataque a un hospital de Gaza que dejó muchos civiles muertos, grupos aliados de Hamas culpando a Israel y viceversa, y una legión de detectives en línea que publicaban en una búsqueda mayoritariamente vana de la verdad. Pero seamos claros acerca de algunas cosas: esta niebla de guerra digital ha existido desde que las redes sociales existen para desplazarse con enojo en tiempos de crisis. E incluso si esa neblina se ha disipado ocasionalmente para un bien mayor, como cuando se ha utilizado para el periodismo ciudadano y la organización de disidentes contra regímenes opresivos, la estructura de incentivos de las redes sociales beneficia principalmente a los poderosos y a los inescrupulosos; recompensa a propagandistas y oportunistas, vendedores ambulantes y cazadores de influencia. Como muchos de nosotros nos sentimos furiosos e impotentes, podríamos aprovechar esta ocasión para considerar las formas en que las redes sociales nos engañan haciéndonos creer que estamos interactuando con la historia, en lugar de gritarle a un pantalla, y cómo las grandes tecnologías también aprovechan ese impulso, animándonos a publicar publicaciones cada vez más polémicas, incluso antes de que los hechos queden claros, prometiendo recompensar a los más incendiarios con notoriedad y tal vez incluso con pagos. Para solucionar todo esto y dar forma a una red social que aspire a difundir información objetiva de manera confiable, debemos prestar mucha atención a lo que está sucediendo en las trincheras digitales de las plataformas en este momento, y a las formas particulares en que está fallando nuestra cosecha actual. Se apresuró a culpar a Elon Musk por las peores fallas del ecosistema de las redes sociales. Después de todo, Musk es dueño de X, la plataforma anteriormente conocida como Twitter, alguna vez considerada el principal destino en línea para encontrar información actualizada sobre los principales acontecimientos del mundo. Sin duda, Twitter se ha convertido en una fuente de noticias significativamente menos confiable desde que Musk asumió el control y destripó a los equipos de moderación de contenido encargados de mantener a raya los engaños, el acoso y la mala información. Para empeorar las cosas, la sustitución por parte de Musk del anterior «azul» «verificación», que, aunque imperfecto, buscaba verificar las identidades de funcionarios y creadores de noticias, con un sistema de pago que permite a cualquiera comprar esa verificación por 8 dólares al mes, significa que fuentes «verificadas» pueden difundir información errónea, e incluso gane dinero en efectivo a través del programa de reparto de ingresos para creadores de X. (Un estudio realizado por el servicio de clasificación de noticias NewsGuard encontró que el 74% de las afirmaciones virales falsas o sin fundamento sobre la guerra entre Israel y Hamas se difundieron a través de cuentas pagadas «verificadas».) Ahora es sólo un equipo mínimo contra millones de publicaciones cada día, nuevas incentivos para que los usuarios avanzados publiquen basura mordaz y un programa básico de “notas de la comunidad” donde los usuarios pueden ofrecer voluntariamente aclaraciones y contexto. Pero a la competencia no le está yendo mucho mejor. Facebook y TikTok han estado trabajando activamente para limitar la cantidad de noticias que aparecen en sus plataformas en primer lugar. Por un lado, están protestando contra leyes nuevas y propuestas en Canadá y Estados Unidos que obligan a los gigantes tecnológicos a compensar a las empresas de medios que producen contenido que se comparte en sus plataformas. Por otro lado, las noticias son más difíciles y costosas de moderar que las fotografías de vacaciones y el patrocinio de celebridades. En Instagram, Meta ha estado insertando erróneamente la palabra “terrorista” en traducciones de texto de biografías de cuentas de usuarios que contenían la palabra “palestino”. Pero este problema difícilmente comenzó con Musk o TikTok. Lo que hoy llamamos desinformación ha acompañado a todas las grandes crisis o catástrofes desde que comenzó la era de seguirlas en línea; es un síntoma de las redes sociales a gran escala, punto. Siempre hay imágenes falsas (ese tiburón nadando por la carretera después de cualquier inundación importante en una ciudad, una foto reciclada de una tragedia anterior, un horror transpuesto de otro contexto) y “noticias” de última hora que resultan ser falsas o verdad a medias. Esto se debe a que las redes sociales no están diseñadas de ninguna manera para ser servicios de transmisión de noticias. Como han demostrado numerosos académicos, las plataformas sociales que están diseñadas para llegar (y mostrar anuncios a) la mayor cantidad de personas posible están diseñadas para incentivar contenido incendiario: material violento, polémicas, falsificaciones sensacionalistas. Puede que esto ya sea de conocimiento común, pero la tendencia solo se ha visto exacerbada por la eliminación de barreras como la moderación de contenido sólida o los equipos de confianza y seguridad. En el mejor de los casos, son noticias digitales por cable y, en el peor, un foro de comentarios desquiciado de 8chan. Tomemos como ejemplo la intensa escaramuza en línea que se desarrolló esta semana sobre si fue Israel quien bombardeó un hospital en Gaza, matando al menos a 500 personas, o un cohete palestino que falló. , matando a muchos menos. Desde el principio, las ideologías se calentaban, y quizás el mayor predictor de cuál sería su explicación en línea de la tragedia fue su orientación política. Los detectives aficionados recurrieron a las imágenes satelitales disponibles y a las grabaciones de los cohetes en arco para enviar largos hilos que detallaban por qué. o por qué un lado no fue responsable en función de factores como si el cráter de impacto de la explosión pudo o no tener el tamaño que se ve en las imágenes disponibles. Me recordó a los detectives de Reddit que se pusieron a trabajar a toda marcha después del atentado con bomba en el maratón de Boston hace 10 años, reuniendo pruebas a partir de erratas digitales de vídeos de teléfonos móviles y secuencias de noticias, y finalmente señalaron a un transeúnte inocente como culpable. Dicho esto, el ejemplo también destaca Un hecho del nuevo entorno mediático: en la niebla algorítmica de la guerra, aquellos con más poder y recursos tienen una clara ventaja. Si bien los funcionarios de Gaza culparon a las Fuerzas de Defensa de Israel por el ataque en un comunicado, las FDI respondieron con un paquete de redes sociales mucho más hábil para refutar las afirmaciones: una serie de publicaciones cargadas de gráficos que afirmaban que la explosión fue el resultado de un cohete que fallaba, con información completa sobre lo que afirmó fue un audio interceptado de combatientes de Hamás discutiendo el accidente con niveles peculiares de detalle. Los críticos acusaron al producto mediático de ser un montaje, señalaron que Israel había negado falsamente su responsabilidad antes, y dimos vueltas y vueltas. Como era cierto hace 10 años, la hiperactividad en línea (las teorizaciones febriles, el análisis de capturas de pantalla, las opiniones implacables) — al final no sirvió de mucho, al menos para el 99 % de los implicados. Poco se logró que no se hubiera logrado si los carteles simplemente hubieran esperado a que los periodistas e investigadores realizaran su trabajo. Las redes sociales aún pueden ser cruciales. Ayer estuve en un vuelo, desplazándome por X durante horas hasta que casi me disociaré. Así que encendí CNN y lo que vi allí fue de alguna manera incluso peor: una cobertura de pared a pared alineada casi exclusivamente con el punto de vista de Israel. Una historia sobre cómo Hamás estaba sembrando desinformación en línea, sobre las víctimas de la brutal matanza de Hamás, sobre un israelí heroico que luchó contra los militantes, sobre la administración de Biden que respaldaba las afirmaciones israelíes de que los habitantes de Gaza eran los culpables de la explosión en Gaza. Ninguna de las cuales sería una historia terrible por sí sola, pero en las horas de cobertura que vi, solo hubo una historia sobre Gaza, y se trataba de un médico estadounidense varado allí. Para ver evidencia de las consecuencias de la campaña de bombardeos de Israel, tuve que recurrir a las redes sociales. A pesar de todo, sigue siendo el lugar donde se escuchan las voces que no se transmiten en ningún otro lugar. Después de todo, hay una razón por la que Israel está tratando de cortar el acceso a Internet de Gaza. Pero necesitamos urgentemente descubrir cómo aumentar el cociente de confiabilidad y seguridad en las plataformas, frenar nuestros peores impulsos al usarlas y aumentar nuestros medios. alfabetización sobre ellos en general, nada de lo cual es probable que suceda cuando las plataformas en cuestión están dirigidas por un megalómano egoísta o dependen de un aumento infinito de los ingresos publicitarios, o ambas cosas. En la era de la negación de la COVID y de QAnon y del colapso de la confianza en nuestras instituciones en todas partes, la verdad parece tan maleable, esquiva e incluso incognoscible como siempre; Después de un ataque atroz que ha generado comparaciones con el 11 de septiembre, y sabiendo cuán falibles eran nuestras instituciones después de esa tragedia, es realmente difícil saber en quién confiar, desde las redes sociales hasta las redes sociales en adelante. Una cosa es Lo cierto es que necesitamos un lugar donde podamos avanzar hacia una comprensión compartida de los acontecimientos mundiales. Pero los parques propiedad de multimillonarios nunca serán ese lugar.

Source link