Varios legisladores tienen rencor con los creadores detrás de esas imágenes sexualmente explícitas de IA de Taylor Swift que circularon en las redes sociales el jueves. Los representantes de Nueva York Joe Morelle e Yvette Clarke, ambos demócratas, centraron su atención en el último incidente de alto perfil de pornografía deepfake y condenaron la mayor creación y proliferación de imágenes generadas por inteligencia artificial que afectan abrumadoramente a mujeres y niños. «La difusión de imágenes explícitas de Taylor Swift generadas por IA es espantosa y, lamentablemente, les está sucediendo a las mujeres en todas partes, todos los días», dijo Morelle en un tweet. «Es explotación sexual», añadió Morelle, antes de promocionar su propuesta de Ley de Prevención de Deepfakes de Imágenes Íntimas, un proyecto de ley que haría ilegal compartir pornografía deepfake sin el consentimiento de las personas retratadas. En su tuit, Clarke señaló que las mujeres han sido sometidas a deepfakes no consensuales durante años y que los avances en la tecnología de inteligencia artificial están haciendo que sea más fácil y barato para las personas crear deepfakes. «Este es un problema que ambos lados del pasillo e incluso los Swifties deberían poder unirse para resolverlo», escribió Clarke. Los políticos publicaron sus declaraciones horas después de que los fanáticos de Swift expresaran su indignación en X (anteriormente Twitter). “Protect Taylor Swift” se convirtió en un grito de guerra para los Swifties el jueves mientras apoyaban a la ganadora del Grammy. Las imágenes manipuladas eran de naturaleza pornográfica y hacían referencia al romance de alto perfil del cantante de “Midnights” con el ala cerrada de los Kansas City Chiefs, Travis Kelce. Lo que le pasó a Taylor Swift no es nada nuevo. Durante años, las mujeres han sido blanco de deepfakes sin su consentimiento. Y con los avances en IA, crear deepfakes es más fácil y económico. Este es un problema que ambos lados del pasillo e incluso los Swifties deberían poder unirse para resolverlo. Yvette D. Clarke (@RepYvetteClarke) 25 de enero de 2024 Un número de Swifties se encargaron de denunciar las cuentas X que comparten los deepfakes de Swift. “Es realmente aterrador que existan. Por favor, informe y no preste más atención a esos tweets”, dijo el usuario @naboocoffee, quien compartió una captura de pantalla de su actividad de informes. “Tenemos que proteger a Taylor Swift de toda esta IA b-. ¡¡¡No me importa si ella no me conoce, es una decencia humana básica no permitir que tu imagen sea explotada haciendo porno con IA!!!”, publicó @everhero13. «Protégela, no hagas mal uso de la tecnología», escribió @WhyParker_. «La IA de Taylor Swift es repugnante». La publicación de imágenes de desnudos no consensuales (NCN) está estrictamente prohibida en X y tenemos una política de tolerancia cero hacia dicho contenido. Nuestros equipos están eliminando activamente todas las imágenes identificadas y tomando las medidas adecuadas contra las cuentas responsables de publicarlas. Estamos estrechamente…— Seguridad (@Safety) 26 de enero de 2024 Horas después de que circularan las imágenes, el equipo de seguridad de X recordó a los usuarios el jueves por la noche su “política de tolerancia cero” al compartir “imágenes de desnudos no consensuales (NCN)”. La declaración, que no menciona explícitamente a Swift, también dice que los usuarios que publicaron las imágenes serían responsables. «Estamos monitoreando de cerca la situación para garantizar que cualquier infracción adicional se aborde de inmediato y que el contenido se elimine», agregó la cuenta de seguridad de X. «Estamos comprometidos a mantener un entorno seguro y respetuoso para todos los usuarios». Un representante de Swift no respondió a las múltiples solicitudes de comentarios del Times. Las imágenes de IA provocaron la indignación pública un mes después de que una madre de Nueva Jersey instara a los legisladores a promulgar más protecciones contra la tecnología de IA después de que circularan en su escuela secundaria imágenes falsas de desnudos de su hija de 14 años y otras compañeras de clase. «Estamos luchando por nuestros hijos», dijo Dorota Mani, residente de Westfield. “No son republicanos ni demócratas. No les importa. Solo quieren ser amados y quieren estar a salvo”. El año pasado, los populares streamers de Twitch Imane “Pokimane” Anys, Maya Higa y QTCinderella se pronunciaron en contra de los deepfakes después de enterarse de que sus imágenes se utilizaban sin su consentimiento para un sitio web pornográfico de inteligencia artificial. . “Todos, joder, deténganse. Deja de difundirlo. Deja de publicitarlo. Detente”, tuiteó QTCinderella. “Ser visto ‘desnudo’ en contra de tu voluntad NO DEBE SER PARTE DE ESTE TRABAJO”. En los últimos años, la IA se ha convertido en un dolor de cabeza para Hollywood y otros creadores. En medio de la huelga de actores del año pasado, Tom Hanks advirtió a sus seguidores sobre un anuncio de un plan dental que utilizaba una “versión IA de mí”. “No tengo nada que ver con eso”, dijo en una publicación de Instagram. Puede que Swift sea una estrella de alto perfil que supuestamente se unió al club multimillonario el año pasado, pero sus fanáticos dicen que sigue siendo una “persona real” que merece respeto y dignidad. «‘Ella es una multimillonaria blanca’ nunca es una excusa para difundir imágenes de IA de mujeres sexualizando», dijo @jdjoshi60. “PROTEJA A TAYLOR SWIFT”. El redactor del Times, Brian Contreras, y Associated Press contribuyeron a este informe.

Source link

Etiqueta: semejanza

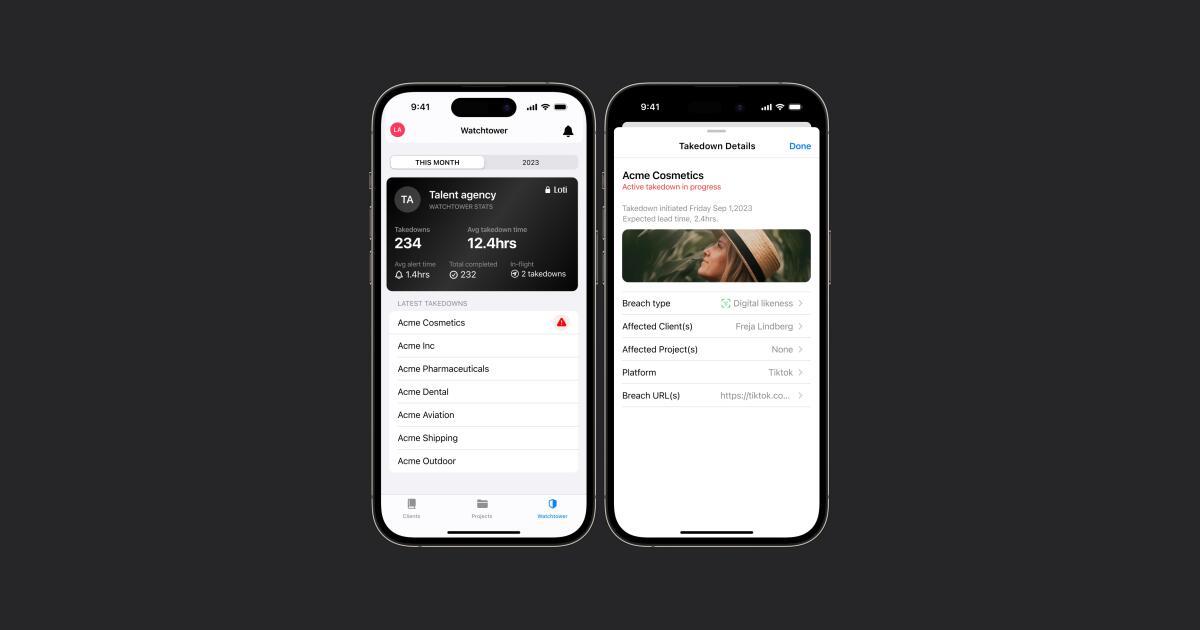

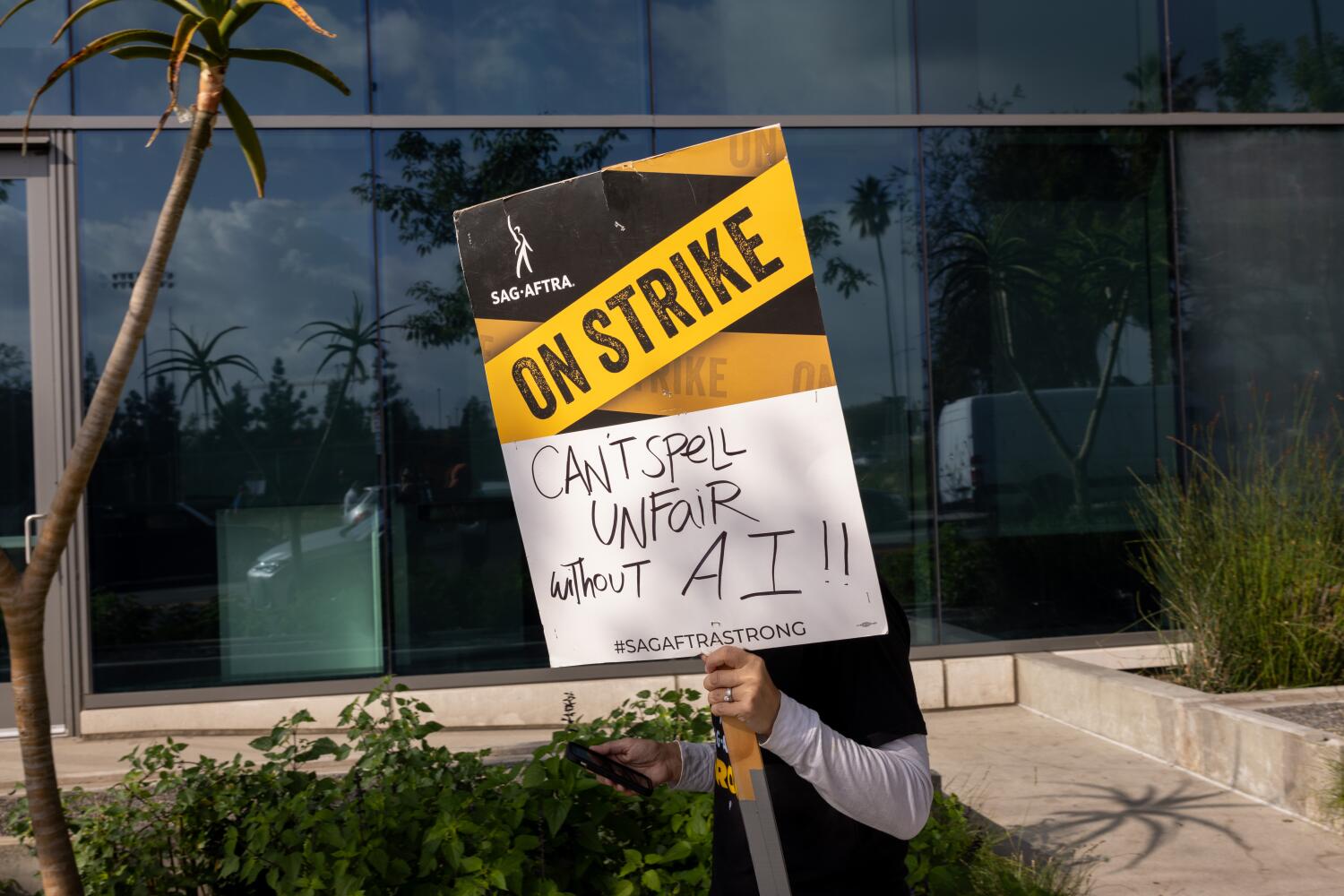

A medida que proliferan los avances en inteligencia artificial, las agencias de talentos están reforzando sus defensas para proteger a las estrellas de Hollywood contra imágenes o videos engañosos y manipulados que pueden poner en riesgo a sus clientes. El auge de la IA generativa y los “deepfakes”, o videos e imágenes que utilizan una la imagen de una persona de forma falsa, han dado lugar a una amplia proliferación de clips no autorizados que pueden dañar las marcas y los negocios de las celebridades. Estos clips pretenden mostrar a personajes famosos diciendo y haciendo cosas que nunca dijeron o hicieron. Por ejemplo: desnudos falsos de una persona famosa o vídeos elaborados para que parezca que una estrella de Hollywood promociona un producto que en realidad no ha utilizado. Y se espera que el problema crezca. Ahora existen herramientas tecnológicas que utilizan la IA para combatir esa amenaza, y la industria del entretenimiento ha llamado a su puerta. La agencia de talentos WME se ha asociado con Loti, una firma con sede en Seattle que se especializa en software utilizado para señalar contenido no autorizado publicado con imágenes de clientes en Internet. La compañía, que tiene 25 empleados, envía rápidamente solicitudes a plataformas en línea para que se eliminen las fotos y videos infractores. Los detalles financieros del acuerdo no fueron revelados. La inteligencia artificial ha sido vista como amiga y enemiga en Hollywood: una herramienta que potencialmente podría hacer que los procesos sean más eficientes e inspirar nuevas innovaciones, pero también es vista como una asesina de empleos y otra forma más de robar la propiedad intelectual. La necesidad de mejores protecciones contra la IA jugó un papel central en las huelgas del verano pasado del Writers Guild of America y el gremio de actores SAG-AFTRA. El martes, la organización sin fines de lucro Artist Rights Alliance publicó una carta abierta a las empresas de tecnología exigiendo que «dejen de devaluar» su trabajo, con firmas de 200 músicos, entre ellos Billie Eilish y Elvis Costello. A medida que se multiplican los deepfakes, las agencias esperan utilizar la IA para detener a los malos actores en línea. “El peor juego de golpear al topo que vas a jugar es lidiar con el problema de los deepfake sin un socio tecnológico que te ayude”, dijo Chris Jacquemin. , socio de WME y jefe de estrategia digital. El cofundador de Loti, Luke Arrigoni, lanzó la startup hace aproximadamente un año y medio. Anteriormente dirigió una empresa de inteligencia artificial llamada Arricor AI y antes fue científico de datos en Creative Artists Agency, el principal rival de WME. Arrigoni dijo que Loti comenzó a trabajar con WME hace unos cuatro o cinco meses. Los clientes de WME le dan a Loti algunas fotos de ellos mismos desde diferentes ángulos. También grabaron clips de audio cortos que luego se utilizan para ayudar a identificar contenido no autorizado. El software de Loti busca en la web e informa a los clientes sobre estas imágenes no autorizadas y envía solicitudes de eliminación a las plataformas. «Existe una sensación cada vez mayor de que éste es un problema imposible», dijo Arrigoni. “Ahora existe un refrán en el que la gente dice: ‘Una vez que está en Internet, estará en Internet para siempre’. Toda nuestra empresa disipa ese mito”. Arrigoni se negó a decir los términos financieros de la asociación o cuántos clientes de WME están utilizando la tecnología de Loti. Antes de utilizar la tecnología de Loti, dijo Jacquemin, su agencia tendría que luchar contra el problema de los deepfakes de forma mucho más ad hoc. Tendrían que pedir a las plataformas web, como YouTube y Facebook, que eliminen los materiales no autorizados basándose en lo que vieron mientras navegaban o en lo que escucharon a través de sus clientes, cuyos fanáticos señalarían el material manipulado. La tecnología de Loti proporciona más visibilidad sobre el tema. Puede haber circunstancias en las que no se elimine todo el contenido no autorizado, según los deseos del cliente. Pero al menos los artistas sabrán lo que hay ahí fuera. En 2022, plataformas como Meta y Google ya estaban lidiando con la eliminación de miles de millones de anuncios o cuentas publicitarias que violaban sus políticas de engaño, dijo Jacquemin. Ahora, cada vez más personas en Hollywood están preocupadas por cómo los nuevos modelos de IA, algunos de los cuales están entrenados en parte con datos disponibles públicamente, podrían potencialmente utilizar obras protegidas por derechos de autor. Estas tecnologías podrían desdibujar aún más la línea entre lo real y lo falso. Si el contenido falso dañino se mantuviera durante demasiado tiempo, podría perjudicar las oportunidades comerciales y los respaldos comerciales de un cliente. «Son tan realistas que a la mayoría de la gente le resultaría difícil notar la diferencia», dijo Arrigoni. Esta es la última asociación que WME y su empresa matriz Endeavor han realizado con una empresa relacionada con la IA. En enero, WME se asoció con la startup Vermillio, con sede en Chicago, para proteger a los clientes contra el robo de propiedad intelectual, detectando cuándo el contenido generativo de IA utiliza la imagen o la voz de un cliente. Endeavour es un inversor minoritario en Speechify, que fabrica tecnología de texto a voz. El director ejecutivo de Endeavor, Ari Emanuel, utilizó la herramienta Speechify para crear una versión sintética de su voz, que pronunció el discurso de apertura de una conferencia telefónica sobre resultados de Endeavor el año pasado. (El martes, Endeavor anunció que su mayor accionista, Silver Lake, privatizará la empresa en un acuerdo que la valorará en 13.000 millones de dólares). Hasta ahora, Loti se autofinancia, dijo Arrigoni. Dijo que él mismo invirtió 1 millón de dólares en la empresa. Actualmente, la empresa se encuentra en el proceso de recaudar una cantidad no revelada para una ronda de semillas.

Source link

Los anuncios falsos generados por IA están volviendo a circular en las redes sociales, esta vez utilizando la voz y la imagen de Taylor Swift que promete juegos de utensilios de cocina Le Creuset gratuitos. Como todo Swiftie sabe, el cantante de “Hoax” es fanático de Le Creuset. En el documental de 2020 de la estrella del pop, “Miss Americana”, preparó un poco de salsa para pasta en la olla azul de la marca. Y en 2014, Swift sorprendió a la «superfan» Gena Gabrielle al asistir a su despedida de soltera con varios obsequios, incluidos dos artículos de la línea de utensilios de cocina de lujo. Los estafadores utilizaron tecnología de inteligencia artificial para crear una versión sintética de la voz de la cantante, la neoyorquina. Times informó el martes. El audio se reprodujo sobre varias imágenes de productos de Le Creuset y clips de Swift, algunos extraídos de su entrevista de 2016 con Vogue, “73 preguntas con Taylor Swift”, en la que la ganadora del Grammy ofrece al medio un recorrido por su casa mientras responde rápidamente. preguntas de fuego. En múltiples anuncios de redes sociales, la voz de Swift se manipula para que suene como si estuviera «encantada» de regalar a sus «fans leales» juegos de utensilios de cocina que están disponibles debido a un «error de embalaje». Los fanáticos solo necesitan ofrecer su información personal y pagar una tarifa de envío de $9,96. Un portavoz de Le Creuset dijo a The Times en un comunicado que la marca no está involucrada con Taylor Swift para ningún obsequio al consumidor. «Todos los obsequios o promociones aprobados de Le Creuset provienen de las cuentas sociales oficiales de Le Creuset», dice el comunicado. «Los consumidores siempre deben consultar las cuentas sociales oficiales y el sitio web de Le Creuset antes de hacer clic en cualquier anuncio sospechoso». El representante de Swift no respondió de inmediato a la solicitud de comentarios del Times. Los avances recientes en inteligencia artificial han facilitado la creación de deepfakes y clips de audio convincentes de celebridades. “Estas herramientas se están volviendo muy accesibles hoy en día”, dijo al New York Times Siwei Lyu, profesor de informática que dirige el Laboratorio Forense de Medios de la Universidad de Buffalo. Lyu añadió que podría llevar menos de 45 minutos hacer un “video de calidad decente”. Lyu continuó diciendo que el sorteo falso de Le Creuset probablemente se creó utilizando un servicio de conversión de texto a voz, que puede traducir un guión a una voz generada por IA y luego combinarlo con un vídeo mediante un software de sincronización de labios. En junio pasado, “Yellowstone La estrella y músico country Lainey Wilson vio cómo los estafadores utilizaban su voz y su imagen para vender gomitas para bajar de peso. El creador de éxitos de “Heart Like a Truck” compartió un video en Instagram criticando los anuncios falsos. “A estas alturas, estoy seguro de que muchos de ustedes habrán visto algunos anuncios sobre mí perdiendo peso, siendo hospitalizado y luego comencé a tomar algunas gomitas para bajar de peso y bla, bla, bla, me salvaron la vida. Bueno, sorpresa, no es así. cierto”, dijo. “La gente hará cualquier cosa para ganar un dólar, incluso si son mentiras porque nadie me envió gomitas… Los amo a todos. Simplemente no quiero que gastéis vuestro dinero en algo que no es real, no os dejéis engañar”. Y en septiembre, el actor ganador del Oscar Tom Hanks apareció en anuncios dentales deepfake. La estrella de “Asteroid City” rápidamente los derribó a través de su Instagram, compartiendo una imagen del video de la estafa con la leyenda: “¡Cuidado! Hay un vídeo que promociona un plan dental con una versión mía de IA. No tengo nada que ver con eso.» El año pasado, cuando un fuerte aumento en los anuncios falsos de celebridades comenzó a invadir Internet, USA Today compartió una guía para detectar videos generados por inteligencia artificial que explicaba las señales de alerta a tener en cuenta, incluidas la simetría perfecta, la distorsión, las proporciones inusuales y las texturas poco naturales. También hay herramientas de detección de IA a las que se puede acceder en línea, incluido AI or Not y Maybe’s AI Art Detector.

Source link

Grabar nuevas voces en off sin decir una palabra: para un actor de doblaje ocupado, puede parecer un sueño, a menos que le preocupe que se utilice la inteligencia artificial para devaluar su trabajo y hacer innecesaria su contratación. Pero bajo un nuevo acuerdo con una compañía de inteligencia artificial, los miembros del Screen Actors Guild podrán crear y licenciar simulaciones digitales de sus voces para videojuegos y otros proyectos mientras disfrutan de salvaguardias contra su posible uso indebido, anunció el martes el sindicato de trabajadores de Hollywood. Al promocionar un acuerdo con Replica Studios, una empresa de tecnología que dice que está «construyendo la biblioteca más grande del mundo de actores de doblaje con tecnología de inteligencia artificial», durante un evento en la exposición de tecnología CES en Las Vegas, el Director Ejecutivo Nacional de SAG-AFTRA, Duncan Crabtree-Irlanda describió el acuerdo como un ejemplo de cómo otras empresas de tecnología pueden generar confianza con el talento del mundo del espectáculo. El acuerdo se produce a raíz de la prolongada huelga de SAG-AFTRA el año pasado, en la que el sindicato buscó protecciones ampliadas contra la IA de la Alianza de Cine y Televisión. Producers, o AMPTP, el grupo que representa a los principales productores de Hollywood. El contrato que finalmente consiguió el Gremio exigía que los estudios obtuvieran permiso de los actores para poder clonarlos digitalmente y pagar por el uso de esos clones. “Al igual que nuestros términos AMPTP recientemente negociados, los acuerdos de réplica son una expresión de la voluntad de SAG-AFTRA. intención y capacidad de trabajar con los empleadores para crear términos que beneficien y protejan a nuestros miembros, y les permitan aprovechar las oportunidades impulsadas por las nuevas tecnologías”, dijo Crabtree-Ireland desde un atril durante el evento CES. El acuerdo de réplica permitirá la voz profesional. sobre los artistas para “explorar de forma segura nuevas oportunidades de empleo para sus réplicas de voz digitales con protecciones líderes en la industria adaptadas a la tecnología de inteligencia artificial”, según SAG-AFTRA. Las voces simuladas autorizadas en virtud del acuerdo se pueden utilizar en videojuegos y «otros proyectos de medios interactivos», añadió el sindicato. El acuerdo establece tarifas mínimas para los actores de doblaje, dijo Crabtree-Ireland, e incluye barreras de seguridad para garantizar que los artistas sepan qué proyecta un digital. se utilizará la réplica de voz y que consienten su uso en proyectos futuros. Sus datos también deben almacenarse de forma segura. «Este es un gran ejemplo de cómo se hace bien la IA», dijo el presidente de SAG-AFTRA, Fran Drescher, en un comunicado. Las protecciones para los actores de doblaje de juegos se enmarcan en un contrato de SAG-AFTRA para trabajo interactivo. Pero ese contrato, negociado en 2017, no incluía protecciones en torno a la IA. Los actores de voz han dicho que saben que la sociedad no puede detener el avance de la tecnología de IA. En cambio, esperan que los trabajadores puedan obtener contratos que requieran su consentimiento para reproducir su voz o imagen y compensarlos cuando eso suceda. SAG-AFTRA ha estado negociando su contrato de videojuego, el Acuerdo de Medios Interactivos que representa a unos 2.500 artistas, durante más de un año. En septiembre, los miembros votaron para autorizar a los líderes sindicales a convocar una huelga contra las empresas de videojuegos. Aunque la tecnología para reutilizar una imagen o modificar una voz existe desde hace años, los actores dicen que la IA sube la apuesta porque puede extraer más información de manera más eficiente y potencialmente convertirlo en un clon plausible de un actor, combinar el trabajo de los actores o hacerse pasar por un nuevo artista sucedáneo.“Estamos creando nuevas fuentes de ingresos aquí; no estamos reemplazando la antigua forma de hacer las cosas”, dijo Shreyas Nivas, director ejecutivo de Replica Studios. Al explicar cómo podría ser este acuerdo en la práctica, dijo que el popular videojuego “Red Dead Redemption 2” incluía 500.000 líneas de diálogo grabado y sugirió que la actuación de voz automatizada podría hacer que ese proceso sea más barato y más eficiente. representa una amenaza igual o incluso mayor para los artistas en la industria de los videojuegos que en el cine y la televisión, particularmente porque muchos trabajan con locución. disponible”, dijo SAG-AFTRA en un mensaje publicado en su sitio web. “Puedes encontrar las herramientas para hacerlo tú mismo con una simple búsqueda en Google. Sin protecciones, este no sólo será el futuro de cómo se graban las voces de los personajes de los videojuegos, sino que tus propias grabaciones de voz se utilizarán para entrenar los sistemas de inteligencia artificial que te reemplazarán”. Los actores de doblaje han señalado las “mods” de juegos, en las que Los jugadores o fanáticos de un juego alteran el contenido, como prueba de que sus imágenes podrían usarse sin su consentimiento y de maneras que no aprobarían. El año pasado, los actores denunciaron los mods en el popular juego de rol Skyrim, que utilizaba voces generadas por IA basadas en las actuaciones de los actores y las clonaba con fines pornográficos. Las conversaciones entre Replica y SAG-AFTRA comenzaron hace varios años, dijo Nivas. -La huelga de AFTRA, así como la huelga del Writers Guild que la acompañó, encontró que las partes interesadas de todo Hollywood expresaron su preocupación sobre el papel que desempeñará la inteligencia artificial en su industria. Incluso después de que los líderes del SAG consiguieran un contrato, algunos miembros del sindicato sostuvieron que su lenguaje dejaba a los estudios demasiada libertad para utilizar la IA en el futuro. Crabtree-Ireland asintió ante esos críticos durante el evento CES, afirmando que “la tecnología de IA no es algo que podamos bloquear”. y, en cambio, argumentar que el objetivo del sindicato debería ser “canalizar y dirigir esa tecnología de IA de una manera que apoye la creatividad humana” en colaboración con empresas responsables.

Source link

SACRAMENTO – Mientras los actores y escritores de Hollywood continúan en huelga para exigir mejores salarios y beneficios, los legisladores de California esperan proteger a los trabajadores para que no sean reemplazados por sus clones digitales. El miércoles, el asambleísta Ash Kalra (D-San José) presentó un proyecto de ley que daría a los actores y artistas una forma de anular disposiciones en contratos vagos que permiten a los estudios y otras empresas utilizar inteligencia artificial para clonar digitalmente sus voces, rostros y cuerpos. «Existe una creciente preocupación de que la tecnología se utilice para suplantar sus servicios», afirmó Kalra. “No hay duda de que toda persona tiene derecho a controlar su propia imagen y semejanza, así como su voz”. La inteligencia artificial puede generar imágenes, sonidos o incluso réplicas digitales, lo que alimenta la preocupación de que los estudios cinematográficos utilicen la tecnología para acabar con los empleos del entretenimiento. El uso de lo que se conoce como IA generativa ha sido un punto conflictivo en las negociaciones contractuales entre actores en huelga y estudios cinematográficos. Sindicatos como SAG-AFTRA, que representa a actores, locutores y otros trabajadores del entretenimiento, dicen que se necesitan más salvaguardias para protegerlos de la amenaza de la IA a sus medios de vida, incluso si llegan a un acuerdo favorable. El proyecto de ley, que se presentó el día antes de que concluya el jueves la sesión legislativa de California de 2023, es un adelanto de cómo los legisladores estatales esperan proteger a los trabajadores de los peligros potenciales de la IA. La legislación, el Proyecto de Ley 459 de la Asamblea, no será considerada por los legisladores hasta el próximo año. SAG-AFTRA, que ha estado en los piquetes con el Writers Guild of America, apoya la legislación. Los proyectos de ley para regular la IA, incluida la lucha contra la discriminación algorítmica, no lograron avanzar este año en el Capitolio estatal. Dado que las empresas tecnológicas y los estudios de Hollywood son fundamentales para la economía de California, los políticos también están tratando de equilibrar las preocupaciones de que la regulación gubernamental pueda perjudicar la innovación. El gobernador Gavin Newsom está actuando con cautela sobre el tema y a principios de este mes emitió una orden ejecutiva que ordena a las agencias estatales que examinen los beneficios y riesgos de la IA generativa. Según AB 459, los actores, artistas de voz y otros trabajadores que renunciaron a los derechos sobre su voz o imagen, permitiendo a las empresas hacer clones digitales o usarlos en otras aplicaciones de IA generativa, podrían escapar de esos contratos si no estuvieran representados. por un sindicato o abogado. Las disposiciones contractuales que no definan claramente los usos potenciales de una réplica digital generada por IA se considerarían “desmedidas” según la ley de California, lo que significa que no se pueden hacer cumplir. El proyecto de ley se aplicaría retroactivamente. «La velocidad con la que se han adoptado estas tecnologías significa que el impacto no es algo que pueda suceder algún día en el futuro, pero está sucediendo ahora mismo, a medida que los estudios buscan reemplazar a las personas reales con escaneos digitales», Duncan Crabtree-Ireland, SAG- dijo en un comunicado el director ejecutivo nacional y jefe negociador de AFTRA. Añadió que le complacía ver que la legislación «aborda la transferencia poco ética de la propia imagen y semejanza a través de acuerdos de explotación con artistas intérpretes o ejecutantes». La Alianza de Productores de Cine y Televisión, que representa a los estudios en las negociaciones laborales, afirmó en el pasado que cuando se trata de escritura de guiones, la IA plantea «cuestiones creativas y legales difíciles e importantes para todos». En lo que respecta a la actuación, la AMPTP ha pedido consentimiento informado y remuneración justa en los casos en que los actores sean replicados digitalmente. La Asociación Cinematográfica. y la Asociación de la Industria Discográfica. de América no tuvo una declaración sobre la legislación. La Entertainment Software Assn., que representa a la industria de los videojuegos, no respondió a una solicitud de comentarios. Los estudios de Hollywood ya utilizan tecnología para escanear los cuerpos y rostros de los actores para poder crear réplicas digitales de las escenas. James Earl Jones, quien expresó a Darth Vader en “Star Wars”, se retiró pero, según se informa, permitió a Disney y Lucasfilm usar inteligencia artificial y grabaciones de archivo para recrear su amenazadora e icónica voz. Pero los actores también podrían sentirse presionados a ceder los derechos de su voz o imagen digital o no entender completamente un contrato sin un abogado, dijo Kalra. Los extras de películas a quienes se les han copiado digitalmente los cuerpos también temen que serán reemplazados por sus réplicas digitales. Mientras tanto, las empresas de entretenimiento continúan ampliando sus operaciones de IA. Los escritores también han alegado que algunas empresas de tecnología están utilizando su trabajo para entrenar sistemas de inteligencia artificial sin su consentimiento. En julio, la comediante Sarah Silverman y los novelistas demandaron a la empresa matriz de Facebook, Meta, y a OpenAI, quienes desarrollaron una popular herramienta de inteligencia artificial generativa, ChatGPT, alegando que las empresas de tecnología utilizaron sus libros protegidos por derechos de autor para entrenar sistemas de inteligencia artificial. Kalra no fue el único legislador de California que presentó un proyecto de ley sobre IA el miércoles. El senador estatal Scott Wiener (D-San Francisco) dio a conocer un proyecto de ley que responsabilizaría a las empresas de tecnología por no prevenir los riesgos previsibles de seguridad de la IA, además de exigir transparencia y medidas de seguridad para ciertos sistemas de IA. Hora informada anteriormente en el proyecto de ley. «Como sociedad, cometimos un error al permitir que las redes sociales se adoptaran ampliamente sin evaluar primero los riesgos y poner barreras de seguridad», dijo Wiener en un comunicado. «Repetir el mismo error en torno a la IA sería mucho más costoso». A medida que continúan creciendo las preocupaciones sobre la amenaza potencial de la IA a la fuerza laboral creativa, Kalra dijo que los legisladores deben actuar ahora. «Tenemos que adelantarnos a esto y asegurarnos de proteger a quienes luchan por salir adelante, quienes podrían sentirse más obligados a firmar en la línea de puntos», dijo.

Source link

A fines del mes pasado, Tom Hanks advirtió a sus fanáticos que un video en el que parecía ser cómplice del cuidado dental era en realidad una falsificación generada por IA. Y en abril, una canción que presentaba una imitación artificial de Drake y The Weeknd se volvió viral. Ambos casos ilustran la creciente amenaza que los clones de voz y vídeo generados por máquinas representan para los artistas conscientes de las marcas. Ahora, también están siendo citados por un grupo bipartidista de senadores que están presentando un proyecto de política que buscaría frenar las llamadas falsificaciones profundas. El proyecto de ley, llamado Ley de Fomentar los Originales, Fomentar el Arte y Mantener el Entretenimiento Seguro, o NO FALSIFICACIONES: daría tanto a las celebridades como a la gente común un recurso legal para la replicación no autorizada de IA de su imagen, según un borrador de discusión de la ley. Las personas cuya voz o imagen hayan sido replicadas sin su consentimiento mediante software de inteligencia artificial podrían, bajo la actuar, demandar por daños y perjuicios tanto contra el creador del clon de IA como contra cualquier plataforma que lo haya alojado, publicado o distribuido a sabiendas, según el borrador de discusión. El borrador también incluye una serie de excepciones relacionadas con la Primera Enmienda, incluido el uso de clones digitales para noticias, retransmisiones deportivas y documentales, así como en casos de “comentarios, críticas, erudición, sátira o parodia”. “La inteligencia artificial generativa ha abierto puertas a nuevas e interesantes posibilidades artísticas, pero también presenta desafíos únicos que hacen «Es más fácil que nunca utilizar la voz, la imagen o la semejanza de alguien sin su consentimiento», dijo el senador Chris Coons (demócrata por Delaware), uno de los copatrocinadores del borrador, en una declaración escrita. «Los creadores de todo el país están pidiendo al Congreso que establezca políticas claras que regulen el uso y el impacto de la IA generativa, y el Congreso debe lograr el equilibrio adecuado para defender los derechos individuales, cumplir con la Primera Enmienda y fomentar la innovación y la creatividad en la IA». A su patrocinio se unen los senadores Marsha Blackburn (R-Tenn.), Thom Tillis (RN.C.) y Amy Klobuchar (D-Minn.). El borrador de discusión está destinado a establecer principios generales de lo que piensan los legisladores. cómo debería ser la legislación sobre el tema, al mismo tiempo que sirve como un llamado a recibir comentarios, dijo una persona con conocimiento del borrador del texto que no estaba autorizada a hablar públicamente. El individuo agregó que los legisladores pretenden presentar un proyecto de ley basado en el borrador en los próximos meses. Aunque en la propuesta de los senadores se hace hincapié en nombres conocidos como Hanks, Drake y The Weeknd, el recurso legal en cuestión se extendería también a personas que no son celebridades.“No queremos que los estudios de cine puedan reemplazar a un actor vivo con una IA. versión generada de ese actor”, dijo el experto. “No queremos que la gente sentada en sus sótanos pueda crear canciones que suenen como Drake… y luego enviarlas a plataformas de streaming. … Pero al mismo tiempo, tampoco creemos que esto deba ser exclusivo de personas famosas”. Según el borrador propuesto actualmente, los creadores de clones de IA no podrían defenderse simplemente etiquetando su trabajo como no autorizado. Preocupaciones Los rumores sobre la replicación no autorizada de imágenes de individuos han existido durante años, centrados en gran medida en el uso de la IA para crear imitaciones «profundamente falsas» de políticos y celebridades. Pero una reciente explosión en la calidad y accesibilidad del software de inteligencia artificial ha hecho que el problema sea más inmediato, lo que ha llevado a individuos y grupos laborales a contraatacar. SAG-AFTRA, un sindicato que representa a actores y otros artistas, está actualmente en huelga por una variedad de industrias. cuestiones, incluidas preocupaciones sobre la forma en que los estudios de cine y televisión implementarán clones de IA. El gremio ha estado presionando para que se regule cómo y cuándo se puede utilizar la tecnología, lo que se ha convertido en un punto conflictivo. Los estudios, por su parte, han propuesto nuevas regulaciones que exigen que los artistas den su consentimiento a la creación y el uso de dobles de IA en pantalla. Sin embargo, los negociadores sindicales quedaron insatisfechos. El sindicato y los estudios recientemente retomaron las negociaciones, aunque las conversaciones se interrumpieron nuevamente el miércoles. En un comunicado el jueves por la mañana, SAG-AFTRA dijo que la Ley NO FAKES “proporciona una herramienta invaluable para los artistas”. y el presidente del gremio, Fran Drescher, expresó su gratitud a los firmantes por “trabajar para brindar a los artistas recursos y proporcionar herramientas para eliminar material dañino”. también comentó sobre el borrador de discusión, y el grupo de presión del estudio dijo que anticipaba trabajar con el Congreso para equilibrar las libertades creativas con las protecciones en torno a la IA. Hasta cierto punto, esta tecnología ya ha llegado a la pantalla grande. La última entrega de la franquicia “Indiana Jones”, por ejemplo, presentaba de manera destacada un Harrison Ford envejecido, fabricado en parte mediante inteligencia artificial. Varias nuevas empresas y empresas ya están apuntando a aprovechar el poder de procesamiento de la IA en todo, desde el trabajo de efectos visuales hasta el doblaje de diálogos. «Los compositores, actores y nuestra increíblemente talentosa comunidad creativa merecen el derecho a poseer su nombre, imagen y semejanza», dijo Blackburn. en una oracion. «Esta legislación es un buen primer paso para proteger a nuestra comunidad creativa».

Source link