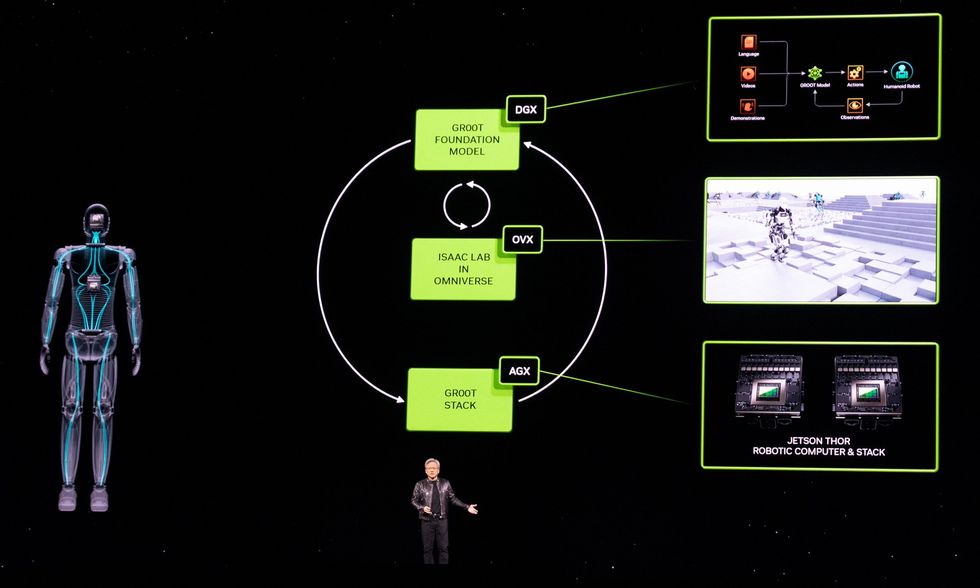

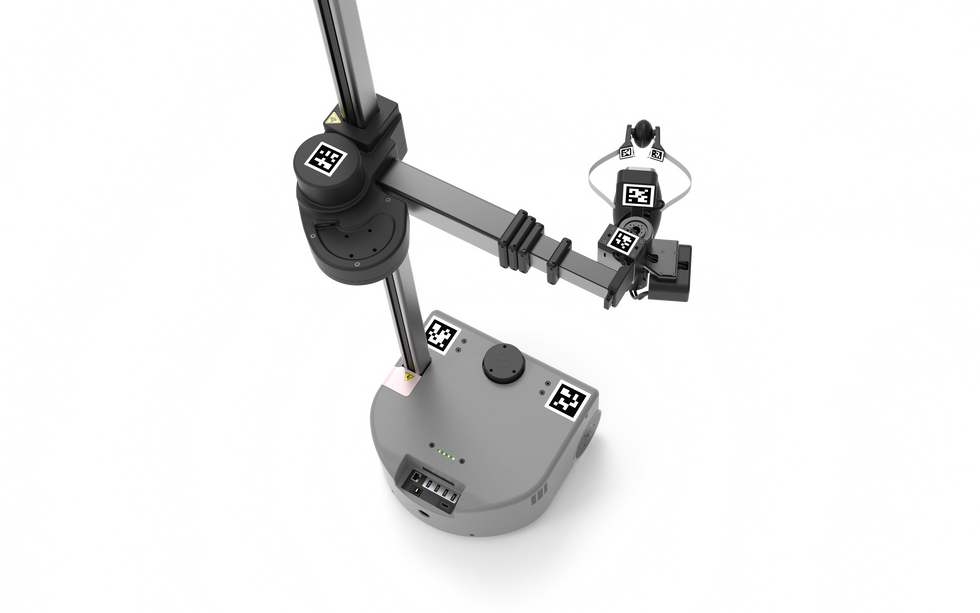

Como era de esperar, la actual conferencia de desarrolladores GTC de Nvidia en San José trata casi exclusivamente sobre IA este año. Pero entre los desarrollos de IA, Nvidia también ha hecho un par de anuncios importantes sobre robótica. Primero, está el Proyecto GR00T (con cada letra y número pronunciados individualmente para no provocar la ira de Disney), un modelo básico para robots humanoides. Y en segundo lugar, Nvidia se ha comprometido a ser el miembro fundador platino de Open Source Robotics Alliance, una nueva iniciativa de la Open Source Robotics Foundation destinada a garantizar que el sistema operativo de robot (ROS), una colección de bibliotecas de software de código abierto y herramientas, tiene el apoyo que necesita para prosperar.GR00TPrimero, hablemos de GR00T (abreviatura de “Tecnología Generalista Robot 00”). La forma en que los presentadores de Nvidia lo enunciaron letra por letra durante sus charlas sugiere claramente que en privado simplemente dicen «Groot». Así que, en lo que a mí respecta, el resto de nosotros también podemos decir simplemente «Groot». Como «modelo básico de propósito general para robots humanoides», el GR00T pretende proporcionar un punto de partida para que robots humanoides específicos realicen tareas específicas. Como es de esperar de algo que se presenta por primera vez en una conferencia magistral de Nvidia, es terriblemente vago en este momento y tendremos que profundizar en ello más adelante. Aquí encontrará prácticamente todo lo útil que Nvidia nos ha contado hasta ahora: “La construcción de modelos básicos para robots humanoides generales es uno de los problemas más interesantes de resolver en la IA hoy en día”, dijo Jensen Huang, fundador y director ejecutivo de NVIDIA. «Las tecnologías habilitadoras se están uniendo para que los principales especialistas en robótica de todo el mundo den pasos de gigante hacia la robótica general artificial». Los robots impulsados por GR00T… serán diseñados para comprender el lenguaje natural y emular movimientos mediante la observación de acciones humanas, aprendiendo rápidamente coordinación y destreza. y otras habilidades para navegar, adaptarse e interactuar con el mundo real. Esto suena bien, pero ese “será” supone mucho trabajo pesado. Aquí falta un “cómo” muy significativo. Más específicamente, necesitaremos una mejor comprensión de lo que subyace a este modelo básico: ¿hay datos reales de robots en alguna parte o se basan en una enorme cantidad de simulación? ¿Las empresas de robótica humanoide implicadas están aportando datos para mejorar GR00T o, por el contrario, entrenando sus propios modelos basándose en ellos? Es ciertamente notable que Nvidia mencione a la mayoría de los pesos pesados en humanoides comerciales, incluidos 1X Technologies, Agility Robotics, Apptronik, Boston Dynamics, Figure AI, Fourier Intelligence, Sanctuary AI, Unitree Robotics y XPENG Robotics. Podremos comunicarnos con algunas de esas personas directamente esta semana para, con suerte, obtener más información. En cuanto al hardware, Nvidia también anuncia una nueva plataforma informática llamada Jetson Thor:Jetson Thor fue creado como una nueva plataforma informática capaz de realizar tareas complejas e interactuar de forma segura y natural con personas y máquinas. Tiene una arquitectura modular optimizada en cuanto a rendimiento, potencia y tamaño. El SoC incluye una GPU de próxima generación basada en la arquitectura NVIDIA Blackwell con un motor transformador que ofrece 800 teraflops de rendimiento de IA de punto flotante de 8 bits para ejecutar modelos de IA generativa multimodal como GR00T. Con un procesador de seguridad funcional integrado, un grupo de CPU de alto rendimiento y 100 GB de ancho de banda Ethernet, simplifica significativamente los esfuerzos de diseño e integración. Hablando de la arquitectura Blackwell de Nvidia, hoy la compañía también presentó su GPU B200 Blackwell. Y para completar los anuncios, la fundición de chips TSMC y Synopsys, una empresa de automatización de diseño electrónico, dijeron que pondrán en producción la herramienta de litografía inversa de Nvidia, cuLitho. La Open Source Robotics AllianceEl otro gran anuncio es en realidad de Open Source Robotics Foundation, que está lanzando Open Source Robotics Alliance (OSRA), una “nueva iniciativa para fortalecer la gobernanza de nuestros proyectos de software de robótica de código abierto y garantizar la salud de la comunidad de Robot Operating System (ROS) Suite durante muchos años por venir. .” Nvidia es el miembro platino inaugural de OSRA, pero no está solo: otros miembros platino incluyen Intrinsic y Qualcomm. Otros miembros importantes incluyen Apex, Clearpath Robotics, Ekumen, eProsima, PickNik, Silicon Valley Robotics y Zettascale. [Open Source Robotics Foundation] Había planeado reestructurar sus operaciones ampliando la participación de la comunidad y expandiendo su impacto en el ecosistema ROS más amplio”, explica Vanessa Yamzon Orsi, directora ejecutiva de la Open Source Robotics Foundation. “La venta de [Open Source Robotics Corporation] fue el primer paso hacia esa visión, y el lanzamiento de OSRA es el siguiente gran paso hacia ese cambio”. Tuvimos tiempo para una breve sesión de preguntas y respuestas con Orsi para comprender mejor cómo afectará esto a la comunidad ROS en el futuro. Usted estructuró la OSRA para que tuviera una membresía mixta y un modelo meritocrático como la Fundación Linux. ¿Qué significa eso exactamente? Vanessa Yamzon Orsi: Hemos modelado la OSRA para permitir caminos hacia la participación en sus actividades a través de membresías pagas (para organizaciones y sus representantes) y los miembros de la comunidad que apoyan los proyectos a través de sus aportes. El modelo mixto permite la participación de la forma más adecuada para cada organización o individuo: contribuyendo con financiación como miembro pagador, contribuyendo directamente al desarrollo del proyecto, o ambos. ¿Cuáles son algunos de los beneficios para el ecosistema ROS que podemos esperar a través de OSRA?Orsi : Esperamos que OSRA beneficie los proyectos de OSRF de tres maneras significativas: proporcionando un flujo estable de financiación para cubrir el mantenimiento y el desarrollo del ecosistema ROS. Fomentando una mayor participación de la comunidad en el desarrollo a través de procesos abiertos y el logro de un estatus meritocrático y abierto. Al lograr una mayor participación de la comunidad en la gobernanza y garantizar que todas las partes interesadas tengan voz en la toma de decisiones. ¿Por qué será esto algo bueno para los usuarios de ROS? Orsi: La OSRA garantizará que ROS y el conjunto de proyectos de código abierto bajo la dirección de Open Robotics seguirá recibiendo apoyo y fortaleciéndose en los años venideros. Al proporcionar gobernanza y supervisión organizadas, caminos más claros hacia la participación comunitaria y apoyo financiero, proporcionará estabilidad y estructura a los proyectos y al mismo tiempo permitirá el desarrollo continuo. De los artículos de su sitio Artículos relacionados en la Web

Source link

Etiqueta: robótica Página 2 de 4

La legendaria roboticista del MIT Daniela Rus ha publicado un nuevo libro llamado The Heart and the Chip: Our Bright Future with Robots. «Hay una revolución robótica en marcha», dice Rus en la introducción del libro, «una que ya está provocando cambios masivos en nuestra sociedad y en nuestras vidas». Tiene toda la razón, por supuesto, y aunque algunos de nosotros hemos sentido que esto es cierto durante décadas, podría decirse que ahora es más cierto que nunca. Pero los robots son difíciles y complicados, y la forma en que su progreso está entrelazado con el de los humanos que los fabrican y trabajan con ellos significa que estos cambios no se producirán rápida ni fácilmente. La experiencia de Rus le brinda una perspectiva profunda y matizada sobre el pasado y el futuro de la robótica, y podemos compartir un poco de eso con usted aquí. Daniela Rus: ¿Deberían los robóticos considerar suscribir su propio juramento hipocrático? El siguiente extracto pertenece al capítulo 14, titulado “¿Qué podría salir mal?” Lo cual, seamos honestos, es la pregunta correcta que debes hacer (y luego intentar responder de manera concluyente) siempre que estés pensando en enviar un robot al mundo real. En varios puntos de este libro he mencionado al personaje ficticio Tony Stark. , que utiliza la tecnología para transformarse en el superhéroe Iron Man. Para mí, este personaje es una tremenda inspiración, pero a menudo me recuerdo a mí mismo que en la historia comienza su carrera como fabricante de armas y desarrollador de municiones formado en el MIT. En la película Iron Man de 2008, cambia su forma de actuar porque descubre que las armas especializadas de su empresa están siendo utilizadas por terroristas. Recuerde, los robots son herramientas. Intrínsecamente no son ni buenos ni malos; lo que importa es cómo elegimos usarlos. En 2022, los drones aéreos se utilizaron como armas en ambos bandos de guerras devastadoras. Cualquiera puede comprar un dron, pero existen regulaciones para su uso que varían entre los diferentes países y dentro de ellos. En Estados Unidos, la Administración Federal de Aviación exige que todos los drones estén registrados, con algunas excepciones, incluidos los modelos de juguete que pesen menos de 250 gramos. Las reglas también dependen de si el dron se vuela por diversión o por negocios. Independientemente de las regulaciones, cualquiera podría usar un robot volador para infligir daño, del mismo modo que cualquiera puede blandir un martillo para lastimar a alguien en lugar de clavar un clavo en una tabla. Sin embargo, los drones también se están utilizando para entregar suministros médicos críticos en áreas de difícil acceso, rastrear la salud de los bosques y ayudar a científicos como Roger Payne a monitorear y defender a las especies en riesgo. Mi grupo colaboró con la compañía de danza moderna Pilobolus para montar la primera representación teatral con una mezcla de humanos y drones en 2012, con un robot llamado Seraph. Entonces, los drones también pueden ser bailarines. En la profética novela de ciencia ficción de Kim Stanley Robinson, El Ministerio para el Futuro, se despliega un enjambre de vehículos aéreos no tripulados para estrellar un avión de pasajeros. También puedo imaginar que una bandada de estos pájaros mecánicos se utilice de muchas maneras buenas. Al comienzo de su guerra contra Ucrania, Rusia limitó el acceso de sus ciudadanos a noticias e información imparciales con la esperanza de controlar y dar forma a la narrativa en torno al conflicto. La verdadera historia de la invasión fue sofocada, y me pregunté si podríamos haber enviado un enjambre de pantallas de video voladoras capaces de organizarse en un monitor aéreo gigante en medio de las plazas populares de las ciudades de toda Rusia, mostrando imágenes reales de la guerra, no simplemente clips aprobados por el gobierno. O, aún más simple: enjambres de proyectores digitales voladores podrían haber transmitido las imágenes en los costados de los edificios y las paredes para que todos las vieran. Si hubiéramos desplegado suficientes, habrían sido demasiados como para cerrarlos. Puede haber variaciones de Tony Stark pasando por mi universidad o los laboratorios de mis colegas en todo el mundo, y debemos hacer todo lo posible para garantizar que estas Jóvenes talentosos se esfuerzan por tener un impacto positivo en la humanidad. El personaje de Tony Stark está moldeado por sus experiencias y orientado a tener un impacto positivo en el mundo, pero no podemos esperar a que todos nuestros tecnólogos soporten experiencias desgarradoras que cambian sus vidas. Tampoco podemos esperar que todos utilicen estas máquinas inteligentes para siempre una vez que hayan sido desarrolladas y puestas en circulación. Sin embargo, eso no significa que debamos dejar de trabajar en estas tecnologías: los beneficios potenciales son demasiado grandes. Lo que podemos hacer es pensar más en las consecuencias y poner barreras para garantizar beneficios positivos. Mis contemporáneos y yo no necesariamente podemos controlar cómo se usan estas herramientas en el mundo, pero podemos hacer más para influir en las personas que las fabrican. Puede haber variaciones de Tony Stark pasando por mi universidad o los laboratorios de mis colegas en todo el mundo. , y debemos hacer todo lo posible para garantizar que estos jóvenes talentosos se esfuercen por tener un impacto positivo en la humanidad. Es absolutamente necesario que haya diversidad en nuestros laboratorios universitarios y centros de investigación, pero es posible que podamos hacer más para moldear a los jóvenes que estudian con nosotros. Por ejemplo, podríamos exigir un estudio del Proyecto Manhattan y los dilemas morales y éticos asociados con el fenomenal esfuerzo por construir y utilizar la bomba atómica. En este punto, los cursos de ética no son un requisito generalizado para obtener un título avanzado en robótica o inteligencia artificial, pero tal vez deberían serlo. ¿O por qué no exigir a los graduados que presten juramento a una variación del juramento hipocrático adaptada a la robótica y la IA? El juramento proviene de un antiguo texto médico griego, que puede haber sido escrito o no por el filósofo Hipócrates, y ha evolucionado a lo largo de los años. siglos. Fundamentalmente, representa un estándar de ética médica que se espera que cumplan los médicos. La más famosa de ellas es la promesa de no hacer daño o evitar cometer actos ilícitos intencionales. También aplaudo el enfoque del juramento en el compromiso con la comunidad de médicos y la necesidad de mantener el vínculo sagrado entre maestros y alumnos. Cuanto más vinculados permanezcamos como comunidad de robótica, cuanto más fomentemos y mantengamos nuestras relaciones a medida que nuestros estudiantes salen al mundo, más podremos hacer para dirigir la tecnología hacia un futuro positivo. Hoy en día, el juramento hipocrático no es un requisito universal para obtener la certificación de médico, y tampoco veo que funcione de esa manera para los robóticos. Tampoco soy el primer experto en robótica o líder en inteligencia artificial que sugiere esta posibilidad. Pero deberíamos considerar seriamente convertirlo en una práctica estándar. Después del desarrollo de la bomba atómica, cuando el potencial de los científicos para causar daño se hizo repentina y terriblemente evidente, hubo cierta discusión sobre un juramento hipocrático para los investigadores científicos. La idea ha resurgido de vez en cuando y rara vez gana fuerza. Pero la ciencia trata fundamentalmente de la búsqueda del conocimiento; en ese sentido es puro. En robótica e inteligencia artificial, estamos construyendo cosas que tendrán un impacto en el mundo, su gente y otras formas de vida. En este sentido, nuestro campo se acerca algo más a la medicina, ya que los médicos están utilizando su formación para impactar directamente en la vida de las personas. Pedir a los tecnólogos que reciten formalmente una versión del juramento hipocrático podría ser una forma de seguir impulsando nuestro campo en la dirección correcta, y tal vez servir como control sobre las personas a las que luego se les pide que desarrollen robots o inteligencia artificial expresamente para propósitos nefastos. La idea misma de lo que es bueno o malo, en términos de cómo se utiliza un robot, depende de dónde te sientes. Me opongo firmemente a dar autonomía a los robots armados o armados. No podemos ni debemos confiar en la inteligencia de las máquinas para tomar decisiones sobre si infligir daño a una persona o a un grupo de personas por su cuenta. Personalmente, preferiría que los robots nunca se utilizaran para hacer daño a nadie, pero esto ya no es realista. Los robots se utilizan como herramientas de guerra y es nuestra responsabilidad hacer todo lo posible para darle forma a su uso ético. Por lo tanto, no me separo ni me divorcio de la realidad y opero únicamente en algún universo utópico de robots felices y serviciales. De hecho, imparto cursos sobre inteligencia artificial a funcionarios de seguridad nacional y les asesoro sobre las fortalezas, debilidades y capacidades de la tecnología. Veo esto como un deber patriótico y me siento honrado de ayudar a nuestros líderes a comprender las limitaciones, fortalezas y posibilidades de los robots y otros sistemas físicos mejorados por IA: lo que pueden y no pueden hacer, lo que deben y no deben hacer. , y lo que creo que deben hacer. En última instancia, no importa cuánto enseñemos y prediquemos sobre las limitaciones de la tecnología, la ética de la IA o los peligros potenciales de desarrollar herramientas tan poderosas, las personas tomarán sus propias decisiones, ya sea que estén estudiantes recién graduados o altos líderes de seguridad nacional. Lo que espero y enseño es que debemos elegir hacer el bien. A pesar de los esfuerzos de las empresas de extensión de vida, todos tenemos un tiempo limitado en este planeta, lo que el científico Carl Sagan llamó nuestro “punto azul pálido”, y debemos hacer todo lo posible para aprovechar ese tiempo al máximo y tener un impacto positivo. en nuestro hermoso entorno y en las muchas personas y otras especies con las que lo compartimos. Mi búsqueda de décadas para construir robots más inteligentes y capaces no ha hecho más que fortalecer mi aprecio por (no, maravillarme) las maravillosas criaturas que se arrastran, caminan, nadan, corren, se deslizan y vuelan a través y alrededor de nuestro planeta, y las fantásticas plantas. , también. No deberíamos ocuparnos del trabajo de desarrollar robots que puedan eliminar estas creaciones cósmicamente raras. En cambio, deberíamos centrarnos en desarrollar tecnologías para preservarlos e incluso ayudarlos a prosperar. Esto se aplica a todas las entidades vivientes, incluida la especie que está especialmente preocupada por el surgimiento de las máquinas inteligentes. Extraído de “El corazón y el chip: nuestro brillante futuro con los robots”. Copyright 2024 de Daniela Rus, Gregory Mone. Utilizado con permiso del editor, WW Norton & Company. Reservados todos los derechos.

Source link

Una demostración reciente realizada por la startup de robótica Figure muestra el potencial de la tecnología ChatGPT de OpenAI para impulsar conversaciones similares a las humanas para robots humanoides. Este desarrollo nos acerca a un futuro en el que los robots puedan integrarse perfectamente en nuestras vidas a través de la interacción del lenguaje natural. Los robots humanoides se acercan un paso más a la interacción natural con el procesamiento del lenguaje de OpenAI. Figure está construyendo un robot de propósito general, Figura 01, diseñado para automatizar tareas que actualmente se consideran indeseables o inseguras para los humanos. Al asociarse con OpenAI en enero de 2024, su objetivo era mejorar las capacidades del robot en percepción, razonamiento e interacción. El vídeo recién publicado ofrece un vistazo a estos avances. A través de los modelos de lenguaje de OpenAI, la Figura 01 ahora puede interpretar su entorno y entablar una conversación. El vídeo demuestra la capacidad del robot para identificar objetos, comprender comandos generales y responder en consecuencia. Cuando se le presenta una manzana y se le pide comida, la Figura 01 reconoce la manzana como comestible y cumple la solicitud. En particular, el robot explica su razonamiento, destacando su capacidad no sólo de reaccionar sino también de contextualizar sus acciones. La Figura 01 demuestra aún más su comprensión de situaciones más amplias. Recoge la basura cercana con una simple orden e incluso reconoce la necesidad de mover los platos vacíos a una rejilla para secar. Si bien el robot se toma un momento para procesar cada instrucción, su capacidad para captar la intención detrás de los comandos generales significa un paso significativo hacia la interacción intuitiva entre humanos y robots. La fecha oficial de lanzamiento de la Figura 01 sigue sin revelarse. Sin embargo, la colaboración con OpenAI subraya su compromiso de acelerar el despliegue comercial de estos robots. Este desarrollo tiene el potencial de revolucionar varias industrias mediante la introducción de robots que no sólo pueden realizar tareas sino también colaborar eficazmente con trabajadores humanos a través del lenguaje natural. El futuro de los robots humanoides con procesamiento del lenguaje natural El futuro de los robots humanoides con procesamiento del lenguaje natural (PLN) encierra una inmensa promesa para revolucionar la interacción entre humanos y robots. Estas son algunas áreas potenciales de crecimiento: Colaboración mejorada: imagine robots integrándose perfectamente en los lugares de trabajo, comprendiendo instrucciones habladas e incluso ofreciendo sugerencias para mejorar los flujos de trabajo. La PNL puede capacitar a los robots para que se conviertan en socios colaborativos, no sólo en reemplazos, de los trabajadores humanos. Cuidado mejorado: los robots humanoides equipados con PNL podrían brindar compañía y asistencia a personas mayores o con limitaciones físicas. Podrían comprender y responder solicitudes, ofrecer recordatorios e incluso entablar conversaciones para combatir la soledad. Educación y formación avanzadas: los robots impulsados por PNL podrían personalizar las experiencias de aprendizaje adaptando su estilo de comunicación a cada estudiante. Podrían responder preguntas, brindar comentarios y actuar como tutores incansables, haciendo que la educación sea más accesible y atractiva. Servicio al cliente de siguiente nivel: las interacciones del servicio al cliente podrían transformarse mediante robots que puedan comprender el lenguaje natural, responder preguntas complejas e incluso navegar por los matices emocionales. Esto agilizaría los procesos, mejoraría la satisfacción del cliente y liberaría a los agentes humanos para tareas más complejas. Accesibilidad universal: la PNL puede cerrar la brecha de comunicación para las personas con discapacidad. Los robots podrían traducir el lenguaje de señas, convertir voz en texto y viceversa, fomentando una mayor inclusión social. Desafíos a abordar: Si bien el futuro es brillante, hay desafíos a considerar: Preocupaciones éticas: a medida que los robots se vuelven más sofisticados, será necesario abordar cuestiones relacionadas con el tratamiento ético y el posible desplazamiento laboral. Noticias de la semana de Gizchina Seguridad y protección: Se deben implementar salvaguardias sólidas para garantizar que los robots funcionen de manera segura, mitigando los riesgos potenciales asociados con la IA avanzada. Sesgo y equidad: los algoritmos de PNL pueden heredar sesgos sociales. Abordar estos sesgos es crucial para garantizar que los robots interactúen con todos de manera justa y sin prejuicios. Revolucionando los lugares de trabajo: la PNL puede marcar el comienzo de una nueva era de colaboración entre humanos y robots. Los robots no se limitarán a realizar tareas; entenderán instrucciones habladas, se adaptarán a situaciones cambiantes e incluso ofrecerán sugerencias para mejorar la eficiencia. Imagine una línea de montaje de una fábrica donde los robots no solo manipulan piezas sino que también se coordinan verbalmente con los trabajadores humanos, ajustando dinámicamente el flujo de trabajo para obtener resultados óptimos. Este enfoque colaborativo podría mejorar significativamente la productividad y la seguridad en diversas industrias. La delicada danza del cuidado: los robots humanoides con PNL tienen el potencial de transformar el cuidado de personas mayores y la vida asistida. Imagine un robot compañero que no sólo pueda comprender las solicitudes de ayuda sino también entablar una conversación, reduciendo los sentimientos de aislamiento y soledad. Sin embargo, surgen consideraciones éticas. ¿Podrán los robots reemplazar realmente la conexión y la empatía humanas, especialmente para aquellos en estados vulnerables? Será crucial lograr el equilibrio adecuado entre la asistencia tecnológica y la auténtica atención humana. La democratización de la educación: los robots impulsados por PNL tienen el potencial de personalizar las experiencias de aprendizaje a gran escala. Un robot tutor equipado con PNL podría adaptar sus explicaciones y estilo de comunicación a las necesidades de cada estudiante, brindando retroalimentación inmediata y abordando las brechas de aprendizaje en tiempo real. Esto podría revolucionar la educación, haciéndola más accesible y atractiva para estudiantes de todos los orígenes y estilos de aprendizaje. Sin embargo, garantizar la igualdad de acceso a dicha tecnología será vital para evitar mayores disparidades educativas. Más allá del servicio al cliente: la PNL puede elevar las interacciones de servicio al cliente mucho más allá de las respuestas escritas. Los robots que comprendan el lenguaje natural, incluidos el humor, el sarcasmo y la frustración, podrían agilizar los procesos y mejorar la satisfacción del cliente. Imagine a un cliente explicando un problema complejo a un robot, y el robot no sólo comprende el problema sino que también sugiere soluciones de una manera que resulta natural y útil. Esto liberaría a los agentes humanos para tareas más complejas y crearía una experiencia de cliente más positiva. Cerrar la brecha de comunicación: la PNL puede ser una herramienta poderosa para la inclusión. Los robots que traducen el lenguaje de señas, convierten la voz en texto y viceversa, pueden cerrar la brecha de comunicación para las personas con discapacidad. Esta tecnología tiene el potencial de derribar barreras y fomentar una sociedad más inclusiva. Sin embargo, garantizar que estos robots estén disponibles y accesibles para todos sigue siendo un desafío. Desafíos en el horizonte: si bien el futuro es prometedor, es necesario superar importantes obstáculos. Deben considerarse cuidadosamente las consideraciones éticas en torno al desplazamiento de empleos y el potencial de los robots para exacerbar las desigualdades sociales. Las medidas sólidas de seguridad y protección serán cruciales para mitigar los riesgos potenciales asociados con la IA avanzada. Además, abordar los sesgos inherentes a los algoritmos de PNL es esencial para garantizar que los robots interactúen de manera justa y sin prejuicios. El camino por delante: Los robots humanoides con PNL representan una poderosa tecnología próxima. Si abordamos cuidadosamente los desafíos y priorizamos el desarrollo ético, podemos aprovechar esta tecnología para crear un futuro en el que los robots trabajen a nuestro lado, no en nuestra contra. Este futuro tiene el potencial de mejorar nuestras vidas de innumerables maneras, desde revolucionar los lugares de trabajo hasta fomentar una sociedad más inclusiva. La clave está en el desarrollo responsable, asegurando que estos avances beneficien a toda la humanidad. En general, el futuro de los robots humanoides con PNL está lleno de posibilidades. Al afrontar cuidadosamente los desafíos, podemos aprovechar esta tecnología para crear un futuro en el que los robots trabajen junto a nosotros, mejorando nuestras vidas de muchas maneras. El futuro de los robots humanoides con procesamiento del lenguaje natural (PNL) presenta un panorama fascinante repleto de inmenso potencial y obstáculos cruciales que superar. Aquí hay una inmersión más profunda en este campo en evolución: Descargo de responsabilidad: es posible que algunas de las empresas de cuyos productos hablamos nos compensen, pero nuestros artículos y reseñas son siempre nuestras opiniones honestas. Para obtener más detalles, puede consultar nuestras pautas editoriales y conocer cómo utilizamos los enlaces de afiliados.

Cuando IEEE Spectrum escribió por primera vez sobre Covariant en 2020, era una nueva startup de robótica que buscaba aplicar la robótica a la recolección en almacén a escala a través de la magia de una única red neuronal de extremo a extremo. En ese momento, Covariant se centró en este caso de uso de recolección, porque representa una aplicación que podría proporcionar valor inmediato: las empresas de almacén pagan a Covariant por sus robots para seleccionar artículos en sus almacenes. Pero para Covariant, lo emocionante fue que la recolección de artículos en los almacenes ha generado, durante los últimos cuatro años, una enorme cantidad de datos de manipulación del mundo real, y probablemente puedas adivinar a dónde va esto. Hoy, Covariant anuncia RFM-1 , que la compañía describe como un modelo básico de la robótica que otorga a los robots la «capacidad de razonar similar a la humana». Eso es del comunicado de prensa, y aunque no necesariamente interpretaría demasiado sobre «humanidad» o «razón», lo que Covariant está haciendo aquí es bastante bueno. «Modelo de base» significa que RFM-1 se puede entrenar en más datos para hacer más cosas; por el momento, todo se trata de manipulación del almacén porque para eso ha sido entrenado, pero sus capacidades se pueden ampliar al suministrarle más datos. «Nuestro sistema actual ya es lo suficientemente bueno como para realizar una selección y colocación muy rápida y variable», afirma el cofundador de Covariant, Pieter Abbeel. “Pero ahora vamos un poco más allá. Cualquier tarea, cualquier encarnación: esa es la visión a largo plazo. Modelos básicos de robótica que impulsan miles de millones de robots en todo el mundo”. Por lo que parece, el negocio de Covariant de implementar una gran flota de robots de automatización de almacenes fue la forma más rápida para recopilar las decenas de millones de trayectorias (cómo se mueve un robot durante una tarea) que necesitaban para entrenar el RFM de 8 mil millones de parámetros. -1 modelo.Covariante“La única forma de hacer lo que estamos haciendo es implementando robots en el mundo que recopilen una tonelada de datos”, dice Abbeel. «Que es lo que nos permite entrenar un modelo básico de robótica que tiene una capacidad única». Ha habido otros intentos de este tipo de cosas: el proyecto RTX es un ejemplo reciente. Pero mientras RT-X depende de que los laboratorios de investigación compartan los datos que tienen para crear un conjunto de datos que sea lo suficientemente grande como para ser útil, Covariant lo está haciendo solo, gracias a su flota de robots de almacén. «RT-X representa aproximadamente un millón de trayectorias de datos», afirma Abbeel, «pero podemos superarlo porque obtenemos un millón de trayectorias cada pocas semanas». «Al construir un valioso robot de recolección que se implementa en 15 países con docenas de clientes, esencialmente tenemos una máquina de recolección de datos». —Pieter Abbeel, Covariant Puede pensar en la ejecución actual de RFM-1 como un motor de predicción para la manipulación de objetos basada en succión en entornos de almacén. El modelo incorpora imágenes fijas, vídeos, ángulos de las articulaciones, lectura de fuerza, fuerza de la ventosa: todo lo relacionado con el tipo de manipulación robótica que realiza Covariant. Todas estas cosas están interconectadas dentro de RFM-1, lo que significa que puedes poner cualquiera de esas cosas en un extremo de RFM-1, y del otro extremo del modelo saldrá una predicción. Esa predicción puede ser en forma de imagen, video o una serie de comandos para un robot. Lo que es importante entender acerca de todo esto es que RFM-1 no se limita a seleccionar solo cosas que ha visto antes, o solo trabajando en robots con los que tiene experiencia directa. Esto es lo bueno de los modelos básicos: pueden generalizar dentro del dominio de sus datos de entrenamiento, y es así como Covariant ha podido escalar su negocio con tanto éxito como lo ha hecho, al no tener que volver a entrenar para cada nuevo robot de recolección o cada nuevo artículo. . Lo que es contrario a la intuición de estos modelos grandes es que en realidad son mejores para enfrentar situaciones nuevas que los modelos entrenados específicamente para esas situaciones. Por ejemplo, digamos que desea entrenar un modelo para conducir un automóvil en una carretera. La pregunta, dice Abbeel, es si de todos modos valdría la pena dedicar tiempo a entrenar en otros tipos de conducción. La respuesta es sí, porque conducir en carretera a veces no es conducir en carretera. Habrá accidentes o tráfico en horas pico que requerirán que conduzcas de manera diferente. Si también se ha entrenado para conducir en calles de la ciudad, estará entrenando efectivamente en casos extremos en carreteras, lo que será útil en algún momento y mejorará el rendimiento general. Con RFM-1, es la misma idea: entrenar en muchos tipos diferentes de manipulación (diferentes robots, diferentes objetos, etc.) significa que cualquier tipo de manipulación será mucho más capaz. En el contexto de la generalización, Covariant habla de la capacidad de RFM-1 para «comprender» su entorno. Esta puede ser una palabra complicada con la IA, pero lo relevante es fundamentar el significado de «comprender» en lo que RFM-1 es capaz de hacer. Por ejemplo, no necesitas entender física para poder atrapar una pelota de béisbol, solo necesitas tener mucha experiencia atrapando pelotas de béisbol, y ahí es donde está RFM-1. También se podría razonar cómo atrapar una pelota de béisbol sin experiencia pero con conocimientos de física, y RFM-1 no hace esto, razón por la cual dudo en usar la palabra «comprender» en este contexto. Pero esto nos lleva a otro Capacidad interesante de RFM-1: funciona como una herramienta de simulación muy eficaz, aunque limitada. Como motor de predicción que genera vídeo, puedes pedirle que genere cómo se verán los próximos segundos de una secuencia de acción, y te dará un resultado realista y preciso, basado en todos sus datos. La clave aquí es que RFM-1 puede simular eficazmente objetos que son difíciles de simular tradicionalmente, como los disquetes. Abbeel de Covariant explica que el «modelo mundial» en el que RFM-1 basa sus predicciones es efectivamente un motor de física aprendido. «Construir motores de física resulta ser una tarea muy desalentadora para cubrir realmente todo lo posible que puede suceder en el mundo», dice Abbeel. “Una vez que se obtienen escenarios complicados, se vuelve muy inexacto, muy rápidamente, porque la gente tiene que hacer todo tipo de aproximaciones para que el motor de física funcione en una computadora. Simplemente estamos haciendo la versión de datos a gran escala de esto con un modelo mundial, y está mostrando resultados realmente buenos”. Abbeel da un ejemplo de pedirle a un robot que simule (o prediga) lo que sucedería si un cilindro se coloca verticalmente sobre una cinta transportadora. La predicción muestra con precisión que el cilindro cae y rueda cuando la cinta comienza a moverse, no porque el cilindro esté siendo simulado, sino porque RFM-1 ha visto muchas cosas colocadas en muchas cintas transportadoras. «Dentro de cinco años, no es improbable que lo que estamos construyendo aquí sea el único tipo de simulador que alguien utilice». —Pieter Abbeel, Covariant Esto solo funciona si existe el tipo correcto de datos para que RFM-1 se entrene, por lo que, a diferencia de la mayoría de los entornos de simulación, actualmente no se puede generalizar a objetos o situaciones completamente nuevos. Pero Abbeel cree que con suficientes datos será posible una simulación mundial útil. “Dentro de cinco años, no es improbable que lo que estamos construyendo aquí sea el único tipo de simulador que alguien utilice. Es un simulador más capaz que uno construido desde cero con verificación de colisiones y elementos finitos y todo eso. Todas esas cosas son muy difíciles de incorporar en tu motor de física de cualquier forma, sin mencionar el renderizador para hacer que las cosas se vean como en el mundo real; en cierto sentido, estamos tomando un atajo». RFM-1 también incorpora datos lingüísticos para poder comunicarse de manera más efectiva con los humanos. Covariant Para que Covariant expanda las capacidades de RFM-1 hacia esa visión a largo plazo de modelos básicos que impulsen “miles de millones de robots en todo el mundo”, el siguiente paso es para alimentarlo con más datos de una variedad más amplia de robots que realizan una variedad más amplia de tareas. «Básicamente, hemos creado un motor de ingesta de datos», afirma Abbeel. «Si está dispuesto a proporcionarnos datos de un tipo diferente, también los incorporaremos». «Tenemos mucha confianza en que este tipo de modelo podría impulsar todo tipo de robots, tal vez con más datos sobre los tipos de robots y los tipos de situaciones en las que podría usarse». —Pieter Abbeel, Covariant De una forma u otra, ese camino implicará una gran cantidad de datos, y serán datos que Covariant no está recopilando actualmente con su propia flota de robots de manipulación de almacenes. Entonces, si usted es, digamos, una empresa de robótica humanoide, ¿cuál es su incentivo para compartir todos los datos que ha estado recopilando con Covariant? «El argumento es que les ayudaremos a llegar al mundo real», dice el cofundador de Covariant, Peter Chen. “No creo que haya muchas empresas que tengan IA para hacer que sus robots sean verdaderamente autónomos en un entorno de producción. Si quieren una IA que sea robusta y poderosa y que realmente pueda ayudarlos a ingresar al mundo real, realmente somos su mejor opción”. El argumento central de Covariant aquí es que, si bien es ciertamente posible que cada empresa de robótica entrene sus propios modelos individualmente, el rendimiento —Al menos para cualquiera que intente realizar manipulación—no sería tan bueno como usar un modelo que incorpore todos los datos de manipulación que Covariant ya tiene dentro de RFM-1. «Siempre ha sido nuestro plan a largo plazo ser una empresa modelo de base de robótica», dice Chen. «Simplemente no había suficientes datos, computación y algoritmos para llegar a este punto, pero construir una plataforma universal de IA para robots, de eso se ha ocupado Covariant desde el principio». De los artículos de su sitioArtículos relacionados en la Web

Source link

Peter Chen, director ejecutivo de la empresa de software para robots Covariant, se sienta frente a una interfaz de chatbot similar a la que se utiliza para comunicarse con ChatGPT. “Muéstrame el bolso que tienes delante”, escribe. En respuesta, aparece un video que revela un brazo robótico sobre un contenedor que contiene varios artículos: un par de calcetines, un tubo de papas fritas y una manzana, entre ellos. El chatbot puede discutir los artículos que ve, pero también manipularlos. Cuando WIRED sugiere que Chen le pida que tome una fruta, el brazo se agacha, agarra suavemente la manzana y luego la mueve a otro contenedor cercano. Este chatbot práctico es un paso para brindar a los robots el tipo de capacidades generales y flexibles. exhibido por programas como ChatGPT. Existe la esperanza de que la IA finalmente pueda solucionar la antigua dificultad de programar robots y hacer que hagan más que un conjunto reducido de tareas. “No es nada controvertido en este momento decir que los modelos básicos son el futuro de la robótica”, dijo Chen. dice, utilizando un término para modelos de aprendizaje automático de propósito general y gran escala desarrollados para un dominio en particular. El práctico chatbot que me mostró funciona con un modelo desarrollado por Covariant llamado RFM-1, por Robot Foundation Model. Al igual que los que están detrás de ChatGPT, Gemini de Google y otros chatbots, ha sido entrenado con grandes cantidades de texto, pero también ha recibido control de video y hardware y datos de movimiento de decenas de millones de ejemplos de movimientos de robots provenientes del trabajo en el mundo físico. mundo. Incluir esos datos adicionales produce un modelo que no solo domina el lenguaje sino también la acción y que es capaz de conectar los dos. RFM-1 no sólo puede chatear y controlar un brazo robótico, sino también generar vídeos que muestran robots realizando diferentes tareas. Cuando se le solicite, RFM-1 mostrará cómo un robot debe agarrar un objeto de un contenedor desordenado. «Puede aceptar todas estas modalidades diferentes que son importantes para la robótica y también puede generar cualquiera de ellas», afirma Chen. «Es un poco alucinante». Vídeo generado por el modelo de IA RFM-1. Cortesía de Covariant Vídeo generado por el modelo de IA RFM-1. Cortesía de Covariant El modelo también ha demostrado que puede aprender a controlar hardware similar que no está en su entrenamiento. datos. Con mayor capacitación, esto podría incluso significar que el mismo modelo general podría operar un robot humanoide, dice Pieter Abbeel, cofundador y científico jefe de Covariant, pionero en el aprendizaje de robots. En 2010, dirigió un proyecto que entrenó a un robot para doblar toallas, aunque lentamente, y también trabajó en OpenAI antes de que dejara de investigar con robots. Covariant, fundada en 2017, actualmente vende software que utiliza el aprendizaje automático para permitir que los brazos robóticos seleccionen artículos. de contenedores en los almacenes, pero normalmente se limitan a la tarea para la que han estado entrenando. Abeel dice que modelos como RFM-1 podrían permitir que los robots utilicen sus pinzas para realizar nuevas tareas con mucha más fluidez. Compara la estrategia de Covariant con la forma en que Tesla utiliza datos de los automóviles que ha vendido para entrenar sus algoritmos de conducción autónoma. «Es más o menos lo mismo que estamos sucediendo aquí», dice. Abeel y sus colegas de Covariant están lejos de ser los únicos expertos en robótica que esperan que las capacidades de los grandes modelos de lenguaje detrás de ChatGPT y programas similares puedan provocar una revolución en robótica. Proyectos como RFM-1 han mostrado resultados iniciales prometedores. Pero la cantidad de datos que se pueden necesitar para entrenar modelos que fabriquen robots con capacidades mucho más generales (y cómo recopilarlos) es una cuestión abierta.

Source link

Video Friday es tu selección semanal de increíbles videos de robótica, recopilados por tus amigos de IEEE Spectrum Robotics. También publicamos un calendario semanal de los próximos eventos de robótica para los próximos meses. Envíenos sus eventos para su inclusión.HRI 2024: 11–15 de marzo de 2024, BOULDER, COLO.Eurobot Open 2024: 8–11 de mayo de 2024, LA ROCHE-SUR-YON, FRANCIAICRA 2024: 13–17 de mayo de 2024, YOKOHAMA, JAPÓNRoboCup 2024: 17–22 de julio de 2024, EINDHOVEN, PAÍSES BAJOS ¡Disfrute de los videos de hoy! Presentamos Human to Humanoid (H2O), un marco basado en aprendizaje por refuerzo (RL) que permite la teleoperación de todo el cuerpo en tiempo real de un robot humanoide de tamaño completo con solo una cámara RGB. Logramos con éxito la teleoperación de movimientos dinámicos de todo el cuerpo en escenarios del mundo real, incluidos caminar, saltar hacia atrás, patear, girar, saludar, empujar, boxear, etc. Hasta donde sabemos, esta es la primera demostración para lograr el aprendizaje. -Teleoperación humanoide de cuerpo entero en tiempo real.[ CMU ]Los robots con patas tienen el potencial de atravesar terrenos complejos y acceder a espacios reducidos más allá del alcance de las plataformas tradicionales gracias a su capacidad para seleccionar cuidadosamente puntos de apoyo y adaptar de manera flexible su postura corporal mientras caminan. Sin embargo, la implementación sólida en aplicaciones del mundo real sigue siendo un desafío abierto. En este artículo, presentamos un método para el control de la locomoción de las piernas utilizando aprendizaje por refuerzo y representaciones volumétricas 3D para permitir una locomoción robusta y versátil en entornos confinados y no estructurados.[ Takahiro Miki ]Claro, 3,3 metros por segundo es rápido para un humanoide, pero estoy más impresionado por los giros mientras camino escaleras abajo.[ Unitree ]Mejorar la seguridad de los manipuladores colaborativos requiere la reducción de la inercia en la parte móvil. Introducimos un enfoque novedoso en forma de un alineador de alambre 3D pasivo, que sirve como un mecanismo de transmisión de potencia liviano y de baja fricción, logrando así la baja inercia deseada en la operación del manipulador.[ SAQIEL ]Gracias, Temma!Robot Era acaba de lanzar Humanoid-Gym, un marco de aprendizaje por refuerzo de código abierto para humanoides bípedos. Como se puede ver en el vídeo, los algoritmos RL le han dado al robot, llamado Xiao Xing, o XBot, la capacidad de subir y bajar cajas apiladas al azar con relativa estabilidad y facilidad.[ Robot Era ]»Captura bimanual consciente del impacto de objetos de gran impulso». ¿Necesito decir mas?[ SLMC ]Más del 80% de los supervivientes de un accidente cerebrovascular experimentan dificultades para caminar, lo que afecta significativamente su vida diaria, su independencia y su calidad de vida en general. Ahora, una nueva investigación de la Universidad de Massachusetts Amherst amplía los límites de la recuperación de un accidente cerebrovascular con un exoesqueleto robótico de cadera único, diseñado como una herramienta de entrenamiento para mejorar la función de caminar. Esto invita a la posibilidad de nuevas terapias que sean más accesibles y más fáciles de trasladar de la práctica a la vida diaria, en comparación con los métodos de rehabilitación actuales.[ UMass Amherst ]¡Gracias, Julia! La manipulación aquí es bastante impresionante, pero es difícil saber qué tan impresionante sin saber también cuánto se aceleró el video.[ Somatic ]Los drones DJI trabajan para hacer del mundo un lugar mejor y una de las formas en que lo hacemos es a través del trabajo de conservación. Nos asociamos con Halo Robotics y OFI Orangutan Foundation International para mostrar cómo estos drones pueden generar un impacto.[ DJI ]El objetivo de la prueba es demostrar la extracción y sustitución de módulos satelitales en un formato CubeSat 27U utilizando el control de realidad aumentada de un robot. En este caso de uso, el satélite «cliente» se actualiza y reabastece de combustible utilizando componentes modulares. Luego, el robot retirará el módulo de computadora defectuoso y lo colocará en un dispositivo. Luego hará lo mismo con el tanque de propulsor. Luego, el robot los colocará correctamente nuevamente en el satélite.[ Extend Robotics ]Este video presenta algunos de los momentos más destacados y favoritos de los CYBATHLON Challenges 2024 que tuvieron lugar el 2 de febrero, mostrando tantos tipos diversos de tecnología de asistencia asumiendo tareas de disciplina y mostrando la tenacidad y determinación de los pilotos. Los Desafíos vieron nuevos equipos, nuevas tareas y nuevos formatos para muchas de las disciplinas de CYBATHLON.[ Cybathlon ]Ha sido un largo camino hacia los robots propulsados eléctricamente.[ ABB ]Pequeños drones para incendios forestales catastróficos (que cubren más de [40,470 hectares]) son como llevar una linterna para iluminar un campo de fútbol. Este breve vídeo describe los principales usos de los drones de todos los tamaños y por qué y cuándo se utilizan, o por qué no.[ CRASAR ]Probablemente no le sorprenda que haya muchos robots involucrados en la construcción de camiones y furgonetas Rivian.[ Kawasaki Robotics ]El programa Learning Introspective Control (LINC) de DARPA está desarrollando métodos de aprendizaje automático que son prometedores para acercar ese escenario a la realidad. LINC tiene como objetivo mejorar fundamentalmente la seguridad de los sistemas mecánicos, específicamente en vehículos terrestres, barcos, enjambres de drones y robótica, utilizando varios métodos que requieren una potencia informática mínima. El resultado es un controlador impulsado por IA del tamaño de un teléfono móvil.[ DARPA ]

Source link

Ya has visto esto antes: un robot de descarga de camiones que se compone de una base móvil con un brazo que se mete en la parte trasera de un remolque y luego usa succión para agarrar cajas apiladas y colocarlas en una cinta transportadora. Hemos escrito sobre un par de empresas que hacen esto y hay aún más por ahí. Es fácil entender por qué: la descarga de remolques implica un entorno bastante estructurado y controlado con una tarea muy repetitiva, es un trabajo duro que apesta para los humanos y hay una enorme cantidad de demanda. Si bien es probable que haya suficiente espacio para un montón de diferentes compañías de robótica en el espacio de descarga de remolques, un cliente determinado probablemente solo elegirá una, y elegirá la que ofrezca la combinación adecuada de seguridad. capacidad y costo. Anyware Robotics cree que tiene esa combinación, con la ayuda de una solución de manejo de cajas que es a la vez muy inteligente y tan obvia que me pregunto por qué no se me ocurrió a mí mismo. El diseño general de Pixmo es bastante estándar en lo que respecta a los robots de descarga de remolques, pero algunos de los detalles son interesantes. Se nos dice que Pixmo es el único sistema de descarga de remolques que integra un brazo colaborativo de carga pesada, en realidad un brazo comercial bastante nuevo de Fanuc. Esto significa que Anyware Robotics no tiene que preocuparse por su propio hardware, y también que su robot es posiblemente más seguro, ya que cuenta con la certificación ISO de seguridad para trabajar directamente con personas. La base es personalizada, pero Anyware la está subcontratando a un gran OEM de robótica. «Hemos hecho un gran esfuerzo para asegurarnos de que la mayoría de los componentes de nuestro robot estén disponibles en el mercado», nos dice el cofundador y director ejecutivo Thomas Tang. «Ya hay tantos proveedores maduros y rentables que queremos dejar la cadena de suministro, la certificación y las pruebas de confiabilidad en manos de otra persona». Y si bien existe una selección de robots móviles automatizados (AMR) que parecen capaces de hacer el trabajo, el problema es que todos están diseñados para superficies planas y entran y salen de la parte trasera del remolque con frecuencia. Implica una rampa corta y empinada, de ahí la necesidad de un diseño propio. Incluso con la base personalizada, Tang dice que Pixmo es muy rentable y la compañía predice que costará aproximadamente un tercio del costo de otras soluciones con una amortización de aproximadamente 24 meses. Pero aquí está la parte realmente inteligente: Anyware Robotics Descarga del remolque de Pixmo Ese sistema transportador frente a las cajas es un complemento que se utiliza como soporte de Pixmo. Aquí hay dos beneficios: primero, tener el complemento transportador alineado con la base de una caja minimiza la cantidad de elevación que tiene que realizar Pixmo. Esto permite a Pixmo manejar cajas de hasta 65 libras con una técnica de elevación y deslizamiento, colocándola en el extremo superior de la carga útil del robot de descarga del remolque. Y el segundo beneficio es que el sistema complementario reduce la distancia que Pixmo tiene para mover la caja lo más pequeña posible, eliminando la necesidad de que el brazo gire para colocar una caja en un transportador al lado. o detrás de sí mismo. Reducir este tiempo de ciclo significa que Pixmo puede alcanzar un rendimiento de hasta 1000 cajas por hora, aproximadamente una caja cada cuatro segundos, lo que según Internet es bastante rápido, incluso para un ser humano profesional. Anyware Robotics presentará este sistema complementario en MODEX la próxima semana y tienen una patente pendiente sobre la idea. Esta parece una idea tan simple y útil que le pregunté a Tang por qué fueron los primeros en proponerla. «En las empresas emergentes de robótica, tiende a haber un problema de mentalidad heredada», me dijo Tang. “Cuando la gente lleva tantos años trabajando en brazos robóticos, simplemente pensamos en cómo utilizarlos para resolverlo todo. Quizás esa sea la razón por la que a otras empresas no se les ocurrió esta solución”. Tang dice que Anyware comenzó con diseños de complementos mucho más complicados antes de encontrar esta solución. «Por lo general, la solución más simple es la que requiere más prueba y error». Anyware Robotics se centra en la descarga de remolques por ahora, pero Pixmo podría adaptarse fácilmente para paletizar y despaletizar o, algo menos fácilmente, para otras tareas del almacén, como la preparación de pedidos o el cuidado de máquinas. Pero ¿por qué detenerse ahí? Un manipulador móvil puede (teóricamente) hacerlo todo (casi), y eso es exactamente lo que quiere Tang: en nuestra visión a largo plazo, creemos que el futuro tendrá dos tipos diferentes de robots de uso general. En una dirección está la forma humanoide, que es una solución realmente flexible para trabajos en los que se desea reemplazar a un humano. Pero hay muchísimos trabajos que simplemente no son razonables para que los realice un cuerpo humano. Por lo tanto, creemos que debería haber otra forma de robot de uso general, diseñado para tareas industriales. Nuestra filosofía de diseño va en esa dirección: también es de uso general, pero para aplicaciones industriales. Con poco más de un año, Anyware ya logró completar un programa piloto (y convertirlo en una orden de compra). Actualmente se encuentran en medio de varios otros programas piloto con proveedores de logística externos líderes y esperan pasar los próximos meses enfocándose en la productización con el objetivo de lanzar la primera versión comercial de Pixmo en julio de este año. Artículos de su sitioArtículos relacionados en la Web

Source link

Video Friday es tu selección semanal de increíbles videos de robótica, recopilados por tus amigos de IEEE Spectrum Robotics. También publicamos un calendario semanal de los próximos eventos de robótica para los próximos meses. Envíenos sus eventos para su inclusión.HRI 2024: 11–15 de marzo de 2024, BOULDER, COLORADO, EE. UU. Eurobot Open 2024: 8–11 de mayo de 2024, LA ROCHE-SUR-YON, FRANCIAICRA 2024: 13–17 de mayo de 2024, YOKOHAMA, JAPÓNRoboCup 2024: 17–22 de julio de 2024, EINDHOVEN, PAÍSES BAJOS ¡Disfruta de los vídeos de hoy! Figure ha recaudado una Serie B de 675 millones de dólares, valorando la empresa en 2.600 millones de dólares.

[

Figure ]

[

Agility Robotics ]

[

Sanctuary AI ]

Ha llegado el momento de que los robots humanoides entren en las líneas de producción industrial y aprendan a ayudar a los humanos realizando tareas repetitivas, tediosas y potencialmente peligrosas para ellos. Recientemente, el robot humanoide Walker S de UBTECH fue introducido en la línea de montaje del centro avanzado de fabricación de vehículos de NIO, como «pasante» que ayuda en la producción de automóviles. Walker S es el primer robot humanoide bípedo que completa las tareas de una estación de trabajo específica en una línea de producción de vehículos eléctricos móviles.

[

UBTECH ]

Henry Evans sigue trabajando duro para mejorar los robots, esta vez con la ayuda de investigadores de la Universidad Carnegie Mellon. Henry dijo que prefería utilizar la teleoperación de asistencia (HAT) en la cabeza con un robot para determinadas tareas en lugar de depender de un cuidador. “Definitivamente rascarse pica”, dijo. “Me encantaría tenerlo a mi lado todo el día, listo para hacer eso o ponerme una toalla en la boca. Además, alimentarme con alimentos blandos, operar las persianas y hacer trabajos ocasionales en la habitación”. Una innovación en particular, el software llamado Driver Assistance, que ayuda a alinear la pinza del robot con un objeto que el usuario desea recoger, fue “increíble”. dijo Enrique. La asistencia al conductor deja al usuario el control mientras realiza ajustes y correcciones finas que pueden hacer que controlar un robot sea tedioso y exigente. «Eso es mejor que cualquier cosa que haya intentado comprender», dijo Henry, y agregó que le gustaría que se utilizara la Asistencia al Conductor para cada interfaz que controle los robots Stretch.

[

HAT2 ] a través de [ CMU ]

Mire este video para los tres gloriosos segundos al final.

[

Tech United ]

¡Prepárate para rasgar, cortar, cortar y rasgar, ya que DOOM ha vuelto! Este abril, haremos que el legendario juego se pueda jugar en nuestros cortacéspedes robóticos como tributo a 30 años acabando con demonios. Oh, es HOOSKvarna, no HUSKvarna.

[

Husqvarna ] a través de [ Engadget ]

Últimos desarrollos demostrados en la plataforma Ameca Desktop. Diviértete con las capacidades de clonación de visión y voz.

[

Engineered Arts ]

[

NYU ]

Los líderes mundiales en manufactura, recursos naturales, energía y servicios públicos están utilizando nuestros robots autónomos para recopilar datos de mayor calidad y mayores cantidades que nunca. Se han desplegado miles de Spots en todo el mundo (más que cualquier otro robot andante) para afrontar este desafío. Esta versión ayuda a los equipos de mantenimiento a aprovechar el poder de la IA con nuevas capacidades de software y mejoras de Spot.

[

Boston Dynamics ]

Los sistemas robóticos modulares autorreconfigurables son más adaptables que los sistemas convencionales. Este artículo propone un novedoso robot autoconfigurable modular de forma libre y estructura de celosía llamado FreeSN, que contiene módulos de nodos y puntales. Este artículo presenta un novedoso sistema de identificación de configuración para FreeSN, que incluye localización magnética de puntos de conexión, identificación de módulos, fusión de orientación de módulos y fusión de configuración del sistema.

[

Freeform Robotics ]

El OOS-SIM (On-Orbit Servicing Simulator) es un simulador para tareas de servicio en órbita, como reparación, mantenimiento y montaje, que deben realizarse en satélites que orbitan alrededor de la Tierra. Simula las condiciones operativas en órbita, como la sensación de ingravidez y la fuerte iluminación.

[

DLR ]

La próxima competición CYBATHLON, que se celebrará nuevamente en 2024, derriba barreras entre el público, las personas con discapacidad, los investigadores y los desarrolladores de tecnología. Del 25 al 27 de octubre de 2024, el CYBATHLON se llevará a cabo en formato global en el Arena Schluefweg en Kloten, cerca de Zurich, y en centros locales de todo el mundo.

[

CYBATHLON ]

La historia de George es un testimonio del increíble viaje que se desarrolla cuando la pasión, la oportunidad y la comunidad convergen. Su viaje de entusiasta de los drones a alguien que contribuye activamente a marcar la diferencia no sólo en su comunidad local sino también a nivel mundial; Sirve como un rayo de esperanza para todos los que se atreven a soñar y perseguir sus pasiones.

[

WeRobotics ]

En caso de que lo hayas olvidado, Amazon tiene muchos robots.

[

Amazon Robotics ]

La historia de cincuenta años de innovación robótica de ABB que comenzó en 1974 con la venta del primer robot comercial totalmente eléctrico del mundo, el IRB 6. Björn Weichbrodt fue una figura clave en el desarrollo del IRB 6.

[

ABB ]

Debate sobre robótica del Simposio de robótica e inteligencia artificial de Ingenuity Labs (RAIS2023) del 12 de octubre de 2023: ¿La robótica está ayudando o obstaculizando nuestro progreso hacia los Objetivos de Desarrollo Sostenible de la ONU?

[

Ingenuity Labs ]

Artículos de su sitioArtículos relacionados en la Web

Source link

Video Friday es tu selección semanal de increíbles videos de robótica, recopilados por tus amigos de IEEE Spectrum Robotics. También publicamos un calendario semanal de los próximos eventos de robótica para los próximos meses. Envíenos sus eventos para su inclusión.Cybathlon Challenges: 02 de febrero de 2024, ZURICHHRI 2024: 11–15 de marzo de 2024, BOULDER, COLO.Eurobot Open 2024: 8–11 de mayo de 2024, LA ROCHE-SUR-YON, FRANCIAICRA 2024: 13– 17 de mayo de 2024, YOKOHAMA, JAPÓN ¡Disfruta de los vídeos de hoy! Al igual que un humano real, Acrobot a veces te dará patadas en la cara.

[ Acrobotics ]

¡Gracias Isabel! Me tenías en «robots sin extremidades con forma de gusanos».

[ GitHub ] a través de [ Georgia Tech ]

Filmado en julio de 2017, este video nos muestra usando Atlas para apagar un «incendio» en nuestro muelle de carga. Esto utiliza una combinación de teleoperación y comportamientos autónomos a través de una única computadora remota. Robot construido por Boston Dynamics para el DARPA Robotics Challenge en 2013. Software de IHMC Robotics. Yo diría que en medio de una tormenta es probablemente el mejor momento para iniciar un incendio que se espera que sea extinguido por un robot.

[ IHMC ]

Estamos trabajando duro, pero Atlas todavía tiene tiempo para un descanso para bailar.

[ Boston Dynamics ]

Esto es genial: BruBotics está probando su tecnología de pinzas robóticas autorreparables en pinzas comerciales de Festo.

[ Paper ] a través de [ BruBotics ]

¡Gracias Bram!

[ Hello Robot ]

Inspirados por expertos en cuidados, propusimos un esquema de asistencia robótica interactiva bimanual para vestirse, que no tiene precedentes en investigaciones anteriores. En el esquema, un robot interactivo se da la mano con el humano, apoyándolo/guiándolo así en el proceso de vestirse, mientras el robot realiza la tarea de vestirse. Este trabajo representa un cambio de paradigma en la forma de pensar sobre la tarea de asistencia para vestirse, de un robot a un brazo a dos robots a un brazo.

[ Project ]

¡Gracias Jihong! Tony Punnoose Valayil, del Instituto de Robótica de la Academia de Ciencias de Bulgaria, escribió para compartir algunos robots de rehabilitación manual de muy bajo coste para uso doméstico. En este vídeo, presentamos una rehabilitación asistida por robot de la articulación de la muñeca que puede ayudar a restaurar la fuerza perdida en la extremidad superior debido a un accidente cerebrovascular. Este robot es muy rentable y puede utilizarse para la rehabilitación del hogar. En este vídeo, presentamos un robot exoesqueleto que se puede utilizar en casa para rehabilitar los dedos índice y medio de pacientes afectados por un accidente cerebrovascular. Este robot está construido con un coste de 50 euros para que los pacientes que no son económicamente independientes puedan recibir un mejor tratamiento.

[ BAS ]

Aquí hay un trabajo muy impresionante de la Universidad Noruega de Ciencia y Tecnología (NTNU), que muestra un dron rastreando su posición usando radar y odometría basada en lidar en algunos entornos de pesadilla (para robots), incluido un largo túnel que parece igual en todas partes y un Pasillo lleno de humo.

[ Paper ] a través de [ GitHub ]

Lo siento, pero la gente ya debería saber que no se deben hacer vídeos como este para el crowdfunding de robots sociales. Está en Kickstarter por alrededor de $300, y el hecho de que haya sido financiado tan rápidamente me dice que la gente ya se ha olvidado del apocalipsis social de los robots.

[ Kickstarter ]

Presentamos Orbit, su portal para gestionar instalaciones con uso intensivo de activos a través de inteligencia predictiva y en tiempo real. Orbit ofrece un conjunto completamente nuevo de capacidades de gestión de flotas y unificará su ecosistema de robots Boston Dynamics, comenzando con Spot.

[ Boston Dynamics ]

Han pasado muchas cosas en robótica durante el último año. Todo el mundo se pregunta cómo la IA transformará la robótica, y todos los demás se preguntan si los humanoides van a arruinarla o no, y el resto de nosotros estamos ocupados tratando de no ser atropellados por completo mientras las cosas se sacuden como sea que se muevan. . Mientras tanto, en Hello Robot, se han centrado en hacer que su robot Stretch haga cosas útiles y al mismo tiempo sea asequible, confiable, asequible, ampliable, asequible, amigable para la comunidad y asequible. Estos son algunos problemas realmente difíciles e importantes que a veces pueden verse abrumados por cosas más llamativas. Hoy, Hello Robot anuncia Stretch 3, que proporciona un conjunto de actualizaciones a lo que (con bastante precisión) llaman «el único desarrollador ligero y capaz del mundo». manipulador móvil amigable”. E impresionantemente, han logrado hacerlo sin olvidar toda esa parte «asequible». Hola, RobotStretch 3 tiene el mismo aspecto que las versiones anteriores, pero hay actualizaciones importantes que vale la pena destacar. Lo más impactante es que Stretch 3 ahora viene con el diestro kit de muñeca que solía ser un complemento, y ahora también incluye una cámara Intel Realsense D405 montada justo detrás de la pinza, lo cual es de gran ayuda tanto para la autonomía como para la teleoperación remota. —una nueva característica útil que se incluye con Stretch 3 y que se basa en una investigación del laboratorio de Maya Cakmak en la Universidad de Washington en Seattle. Este es un ejemplo de cómo convertir la innovación de la comunidad de usuarios de Stretch en características del producto, un enfoque de desarrollo de productos que parece estar funcionando bien para Hello Robot. «Realmente hemos estado aprendiendo de nuestra comunidad», dice el cofundador y El director ejecutivo, Aaron Edsinger. “El año pasado, vimos un aumento real en las publicaciones y parece que estamos llegando a este momento crítico con Stretch. Entonces, con Stretch 3, se trata de implementar características que nuestra comunidad nos ha estado pidiendo”. “Cuando lo lanzamos, no teníamos una muñeca diestra al final como estándar, porque estábamos tratando de comenzar con el producto mínimo viable. ”, dice el cofundador y director de tecnología de Hello Robot, Charlie Kemp. «Y lo que descubrimos es que a casi todos los pedidos se les agregaba la muñeca diestra, y al tenerla como estándar, pudimos dedicarle más atención y convertirla en un sistema mucho más robusto y capaz». dice Kemp que hacer que Stretch haga todo desde el primer momento (con soporte de Hello Robot) marca una gran diferencia para sus clientes de investigación. «Hacer que sea más fácil para las personas probar cosas; hemos aprendido a valorarlo realmente, porque cuantos más pasos tengan que pasar las personas para experimentarlo, es menos probable que lo desarrollen». En el contexto de la investigación, esto es importante porque de lo que realmente estamos hablando es del tiempo: cuanto más tiempo dediquen las personas a intentar hacer que el robot funcione, menos tiempo dedicarán a conseguir que el robot haga cosas útiles. Hola robot. En este punto, es posible que esté pensando en Stretch como una plataforma de investigación. O quizás esté pensando en Stretch como un robot para personas con discapacidades, si lee nuestro artículo de portada de noviembre de 2023 sobre Stretch, Henry y Jane Evans. Y el robot es definitivamente ambas cosas. Pero Hello Robot enfatiza que estos mercados específicos no son su objetivo final; ven a Stretch como un manipulador móvil generalista con futuro en el hogar, como sugiere este video promocional de Stretch 3: Hello Robot Vajilla, lavandería, cañones de burbujas: todos estos son fundamental para el funcionamiento de cualquier hogar normal. «Stretch es un robot inclusivo», dice Kemp. “No es sólo para adultos mayores o personas con discapacidad. Queremos un robot que pueda ser beneficioso para todos. Nuestra visión, y lo que creemos que realmente sucederá, ya sea que seamos nosotros o alguien más, es que habrá un robot doméstico versátil y de uso general. En este momento, claramente, nuestro mercado aún no son los consumidores en el hogar. Pero ahí es donde queremos llegar”. Durante décadas se han prometido robots en el hogar y, con la notable excepción del Roomba, no ha habido mucho éxito. La idea de un robot que pueda manipular platos o lavar la ropa es tentadora, pero ¿es realista a corto o mediano plazo? Edsinger, que ha estado en todo este asunto de los robots durante mucho tiempo, es optimista al respecto y sobre el papel que desempeñará Stretch. «Hay muchísimos lugares donde se puede ver el progreso que se está produciendo, en la detección y la manipulación», dice Edsinger. “Puedo imaginar que esas cosas se unirán ahora de una manera que no podría haberlo hecho hace 5 o 10 años, cuando parecía increíblemente difícil”. “Somos muy pragmáticos acerca de lo que es posible. Y creo que creemos que las cosas están cambiando más rápido de lo que anticipamos; hace 10 años, tenía en mente un camino lineal bastante claro para la robótica, pero es difícil imaginar realmente dónde estaremos en términos de capacidades de los robots dentro de 10 años. desde ahora.» —Aaron Edsinger, Hello RobotDiría que todavía es increíblemente difícil, pero Edsinger tiene razón en que muchas de las piezas parecen estar encajando. Podría decirse que el hardware es el mayor desafío aquí, porque trabajar en casa impone grandes limitaciones sobre el tipo de hardware que se puede utilizar. No es probable que veas un humanoide en una casa en el corto plazo, porque sería realmente peligroso, e incluso un cuadrúpedo probablemente causará más problemas de los que vale en un ambiente hogareño. Hello Robot es consciente de esto y ese ha sido uno de los principales impulsores del diseño de Stretch. «Creo que realmente vale la pena destacar la portabilidad de Stretch porque hay mucho valor en algo que tal vez no sea obvio», nos dice Edsinger. . Poder simplemente coger y mover un manipulador móvil no es normal. Es casi trivial trabajar con el peso de Stretch (24,5 kilogramos), en marcado contraste con prácticamente cualquier otro robot móvil con brazo: Stretch cabe en lugares en los que caben los humanos y logra tener un espacio de trabajo similar también, y su parte inferior es pesada. El diseño hace que sea seguro para los humanos estar cerca. No puede subir escaleras, pero se puede subir escaleras arriba, lo cual es más importante de lo que parece. También cabe en la parte trasera de un coche. Stretch está diseñado para explorar el mundo, no sólo una copia del mundo en un laboratorio de investigación. “Los estudiantes de la Universidad de Nueva York han estado llevando Stretch a decenas de hogares en Nueva York”, dice Edsinger. “Subieron uno por un camino de cuatro pisos. Esto permite la recopilación de datos reales en el hogar. Y aquí es donde empezarán a aparecer los robots domésticos: cuando se puedan tener cientos de ellos en los hogares recopilando datos para el aprendizaje automático”. “Ahí es donde está la oportunidad”, añade Kemp. “Es ese compromiso con el mundo sobre dónde aplicar la tecnología de manera beneficiosa. Y si estás en un laboratorio, no lo encontrarás”. Hemos visto algunos ejemplos convincentes de esto recientemente, con Mobile ALOHA. Se trata de robots que aprenden a ser autónomos haciendo que humanos los teleoperen mediante habilidades domésticas comunes. Pero el sistema no es particularmente portátil y cuesta casi 32.000 dólares sólo en piezas. No me malinterpreten: me encanta la investigación, simplemente será difícil escalarla y, para recopilar suficientes datos para abordar el mundo de manera efectiva, la escala es fundamental. Stretch es mucho más fácil de escalar, porque puedes comprar uno o dos. Es posible que hayas notado que algunos de los videos de Stretch 3 tienen dos robots que colaboran entre sí. Esto aún no es autónomo, pero con dos robots, un solo humano (o un par de humanos) puede teleoperarlos como si fueran efectivamente un solo robot de dos brazos: Hola Robot. Básicamente, lo que tienes aquí es un robot de dos brazos. robot que (muy intencionadamente) no tiene nada que ver con humanoides. Como explica Kemp: “Estamos tratando de ayudar a nuestra comunidad y al mundo a ver que existe un camino diferente al modelo humano. Los humanos tendemos a pensar en la solución preexistente: las personas tienen dos brazos, así que pensamos, bueno, voy a necesitar dos brazos en mi robot o tendrá todos estos problemas”. Kemp señala que robots como Stretch han demostrado que en realidad se pueden hacer muchas cosas con un solo brazo, pero dos brazos aún pueden ser útiles para un subconjunto sustancial de tareas comunes. “El desafío para nosotros, para el cual nunca había podido encontrar una solución, era cómo incorporar dos brazos en un manipulador móvil liviano, portátil, compacto y asequible. ¡No puedes!”Pero con dos Estiramientos, no sólo tienes dos brazos, sino también dos hombros que puedes poner donde quieras. ¿Lavar un plato? Probablemente querrás tener dos brazos juntos para una manipulación colaborativa. ¿Hacer una cama? Separe los dos brazos para manipular ambos lados de una sábana a la vez. Es una especie de manipulación bimanual distribuida bajo demanda, que sin duda añade un poco de complejidad pero también resuelve un montón de problemas cuando se trata de manipulación práctica en el hogar. Ah, y si esas herramientas teleop parecen tenazas de cocina modificadas, es porque son tenazas de cocina modificadas. Por supuesto, comprar dos robots Stretch es dos veces más caro que comprar un solo robot Stretch, y aunque el costo de Stretch 3 es de poco menos de $25,000 es muy económico para un manipulador móvil y muy asequible en un contexto de investigación o educación, todavía estamos bastante lejos de algo que la mayoría de las personas podrían permitirse por sí mismas. Hello Robot dice que producir robots a escala es la respuesta, lo cual estoy seguro es cierto, pero puede ser algo difícil de lograr para una pequeña empresa. Avanzar lentamente hacia la escala es al menos en parte intencional, nos dice Kemp. “Todavía estamos en el proceso de descubrir la verdadera forma de Stretch: lo que realmente debería ser el robot. Si intentáramos escalar para fabricar muchísimos robots a un costo mucho menor antes de comprender fundamentalmente cuáles serían las necesidades y los desafíos, creo que sería un error. Y hay muchas lápidas de varias empresas de robótica doméstica, algunas de las cuales realmente me encantaron. No queremos convertirnos en uno de esos”. Esto no quiere decir que Hello Robot no esté intentando activamente hacer que Stretch sea más asequible, y Edsinger sugiere que la próxima versión del robot se centrará más en eso. Pero, y esto es súper importante, Kemp nos dice que Stretch ha sido, es y seguirá siendo sustentable para Hello Robot: “De hecho, cobramos lo que deberíamos cobrar para poder tener un negocio sustentable”. En otras palabras, Hello Robot no depende de un futuro nebuloso definido a escala para realizar la transición a un modelo de negocio que pueda desarrollar, vender y respaldar robots. Pueden hacerlo ahora mismo mientras mantienen las luces encendidas. «Nuestras ventas tienen suficiente margen para que nuestro negocio funcione», dice Kemp. “Eso es parte de nuestra disciplina”. Stretch 3 ya está disponible por $24,950, que es casi lo mismo que el costo de Stretch 2 con los complementos opcionales incluidos. Hay muchísimas otras características nuevas que no pudimos incluir en este artículo, incluida la certificación FCC, un brazo más duradero y compatibilidad con GPU externa. Aquí encontrará una lista útil de todas las actualizaciones. Artículos de su sitio Artículos relacionados en la Web

Source link